Computer Science and Application

Vol.4 No.08(2014), Article

ID:14023,10

pages

DOI:10.12677/CSA.2014.48023

Study on Real-Time Target Tracking

1Beijing Institute of Structure and Environment Engineering, Beijing

2CNPC Greatwall Drilling Engineering Company Limited Mudlogging Company, Panjin

3Beijing Institute of Astronautical Systems Engineering, Beijing

Email: buaahexinhua@126.com

Copyright © 2014 by authors and Hans Publishers Inc.

This work is licensed under the Creative Commons Attribution International License (CC BY).

http://creativecommons.org/licenses/by/4.0/

Received: May 28th, 2014; revised: Jun. 29th, 2014; accepted: Jul. 8th, 2014

ABSTRACT

In this paper, we propose a real-time mobile target detection and tracking algorithm for challenges of mobile target detection and tracking in sequential images. This algorithm based on the adaptive background modeling obtains background model and front-view images of mobile targets, which is the way to achieve target detection. Continuous matching and tracking of multiple mobile targets are realized through constructing position, size, shape and color distribution of the mobile targets, defining a global matching function for those targets, and associating their vitality characteristics. It is demonstrated by experiments that the algorithm presented in this paper, compared to the traditional methods of mobile target tracking, significantly reduces the computation time, improves adaptive feature to environments, achieves accurate detection and robust tracking of mobile targets in complex environments, and shows strong robustness to deformation and rotation of non-rigid targets.

Keywords:Object Detection, Object Tracking, Background Subtraction, Object Matching

实时目标跟踪研究

胡绍华1,陈 勇2,何信华3,沈志军3

1北京强度环境研究所,北京

2中石油长城钻探工程有限公司录井公司,盘锦

3北京宇航系统工程研究所,北京

Email: buaahexinhua@126.com

收稿日期:2014年5月28日;修回日期:2014年6月29日;录用日期:2014年7月8日

摘 要

针对图像序列中运动目标检测、跟踪的难点问题,提出了一种实时运动目标检测与跟踪算法。该算法基于自适应背景建模,获取运动目标背景模型和前景图像,从而实现运动目标检测;通过建立运动目标的位置、大小、形状以及颜色分布模型,构造运动目标全局匹配函数,结合目标活力特征,实现多运动目标连续匹配和跟踪。实验结果表明,相对于传统的运动目标跟踪方法,本文方法明显减少了运算时间,增强了环境适应性,实现了复杂场景下运动目标的准确检测和稳定跟踪,对非刚性目标的形变、旋转具有较强的鲁棒性。

关键词

目标检测,目标跟踪,背景减除,目标匹配

1. 引言

实时运动目标跟踪算法是计算机视觉应用中的关键技术,在军事视觉制导、医疗诊断、视觉监视等领域有着非常重要的实用价值和广阔的发展前景[1] -[4] 。近年来目标跟踪技术得到了蓬勃的发展,比较典型的匹配跟踪算法有:光流法[5] [6] 、帧差法,Mean shift跟踪算法[7] -[9] 、Kalman滤波跟踪算法[10] 、Particle滤波跟踪算法[11] 以及模块匹配等跟踪算法;另一类是基于检测的方法,如背景减除法[12] -[14] 。前者需要人工参与才能完成目标的检测与跟踪,不适合场景中有大量运动目标的情况;后者不需人工参与,适用于静态背景下的运动目标检测与跟踪。文献[5] [6] 提出利用光流法进行运动目标检测,但光流法的计算复杂程度高,且抗噪声能力差,不适用于对实时性要求较高的应用场合;帧差法虽然容易满足实时性,但很难准确地分割出运动目标,易造成空洞和拖尾现象,不利于进一步的运动目标跟踪;背景减除法是利用当前图像与背景图像的差分图像来检测运动目标的一种方法,应用非常广泛。建立简单、可靠的背景模型是背景减除法提高运动目标检测与跟踪可靠性的基础。大部分研究人员目前都致力于开发更为简单、实用的背景模型,以期减少动态场景变化对运动目标检测的影响。为此,本文提出了一种计算量小,且能反映真实背景的背景建模方法,通过建立运动目标的位置、大小、形状以及颜色分布模型,构造运动目标全局匹配函数,结合目标活力特征,实现多运动目标连续匹配和跟踪。在此基础上最终提升了传统运动目标检测与跟踪算法的稳健性和实时性。

2. 建立背景模型

2.1. 简单背景建模

简单的背景建模方法是将当前帧图像与原背景图像直接进行加权得到新的背景图像,即

(1)

(1)

式中, 表示第

表示第 帧建立的背景图像在

帧建立的背景图像在 处的像素值;

处的像素值; 表示第

表示第 帧采集到的真实图像在

帧采集到的真实图像在 处的像素值;

处的像素值;

为加权因子。该方法不需区分运动目标,直接将当前帧图像与前一帧背景图像进行加权获得当前帧背景图像。该模型算法简单,计算量小,但背景图像中有运动目标信息,不能反映真实的背景模型,降低了运动目标检测与跟踪的可靠性。

为加权因子。该方法不需区分运动目标,直接将当前帧图像与前一帧背景图像进行加权获得当前帧背景图像。该模型算法简单,计算量小,但背景图像中有运动目标信息,不能反映真实的背景模型,降低了运动目标检测与跟踪的可靠性。

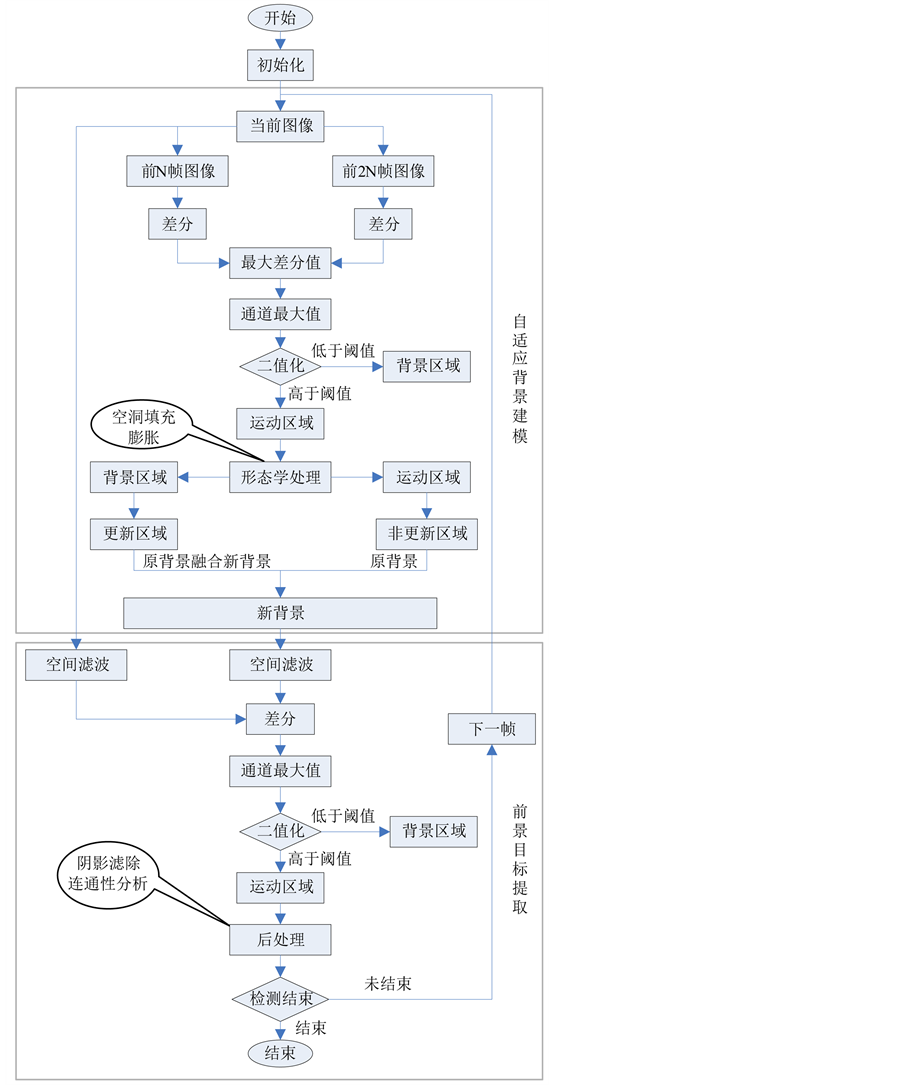

2.2. 自适应背景模型

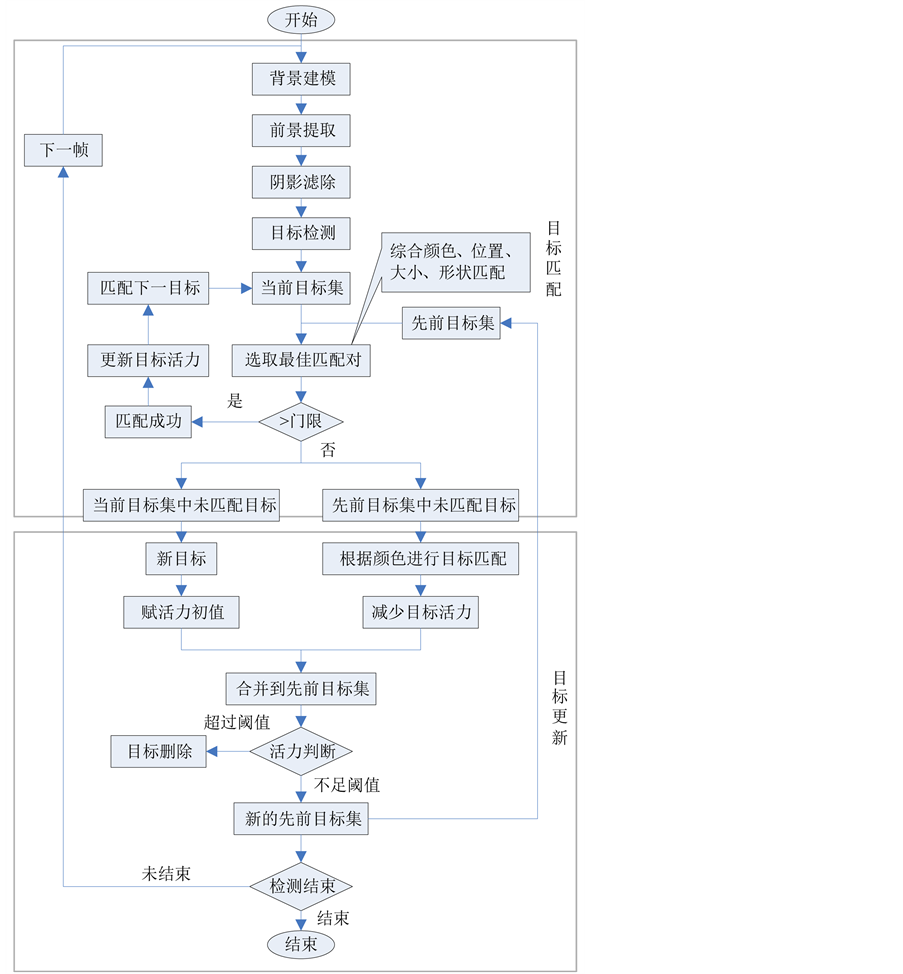

基于自适应背景建模的运动目标检测原理框图如图1所示。

Figure 1. Schematic diagram of adaptive background modeling and object detection

图1. 自适应背景建模及运动目标检测原理框图

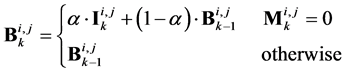

为使建立的背景模型中不含运动目标的信息,经典的背景模型建立方法为

(2)

(2)

式中, 表示第

表示第 帧建立的背景图像在

帧建立的背景图像在 处的像素值;

处的像素值; 表示第

表示第 帧采集到的真实图像在

帧采集到的真实图像在 处

处

的像素值;

为自适应学习因子,

为自适应学习因子, ,

, 为固定学习因子;

为固定学习因子; 的区域为背景

的区域为背景

更新区域,即非运动区域;当 时,

时, ,即用第0帧图像初始化背景图像。该背景建模方法选择性地更新背景,只将

,即用第0帧图像初始化背景图像。该背景建模方法选择性地更新背景,只将 非运动区域更新到

非运动区域更新到 中,而对

中,而对 运动区域不做更新,使得更新的背景就不含有运动目标信息了。该背景建模方法的关键之处在于

运动区域不做更新,使得更新的背景就不含有运动目标信息了。该背景建模方法的关键之处在于 的计算。

的计算。

获取 的的一种方法是直接求取第

的的一种方法是直接求取第 帧真实图像与第

帧真实图像与第 帧背景图像的差值图像,利用差值图像计算

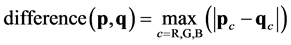

帧背景图像的差值图像,利用差值图像计算 ,其缺点是当运动目标停止一段时间融入背景图像后又突然运动时,在运动目标停止位置会产生一个虚假目标,而且该虚假目标会一直存在。从而影响该区域的背景更新,造成死锁。为解决此问题,可通过计算光流判断目标的真实性,光流超过阈值的目标被定义为真实目标,小于阈值的目标被定义为虚假目标。但光流计算比较复杂,耗时较多。因此本文提出了一种利用多帧混合差分消除虚假目标的方法。该方法相对于光流法,计算量较少,具体的计算公式为

,其缺点是当运动目标停止一段时间融入背景图像后又突然运动时,在运动目标停止位置会产生一个虚假目标,而且该虚假目标会一直存在。从而影响该区域的背景更新,造成死锁。为解决此问题,可通过计算光流判断目标的真实性,光流超过阈值的目标被定义为真实目标,小于阈值的目标被定义为虚假目标。但光流计算比较复杂,耗时较多。因此本文提出了一种利用多帧混合差分消除虚假目标的方法。该方法相对于光流法,计算量较少,具体的计算公式为

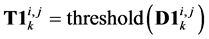

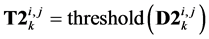

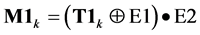

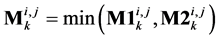

(3)

(3)

(4)

(4)

(5)

(5)

(6)

(6)

(7)

(7)

(8)

(8)

(9)

(9)

(10)

(10)

(11)

(11)

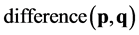

式中, ,

, 为RGB色彩空间向量;函数

为RGB色彩空间向量;函数 获取

获取 ,

, 向量的差值;

向量的差值; 表示第

表示第 帧真实图像与第

帧真实图像与第 帧背景图像的差值图像;

帧背景图像的差值图像; 为利用多帧混合差分获得的差值图像;

为利用多帧混合差分获得的差值图像; 为二次采样间隔;

为二次采样间隔; 为多帧混合差分使用的总帧数;

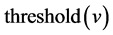

为多帧混合差分使用的总帧数; 为二值化函数;

为二值化函数; 为二值化的阈值;

为二值化的阈值; 为

为 的二值化结果;

的二值化结果; 为

为 的二值化结果;

的二值化结果; 为膨胀操作符;

为膨胀操作符; 为闭运算操作符;

为闭运算操作符; 、

、 、

、 和

和 为结构元素;

为结构元素; 为通过背景减除获得的运动区域;

为通过背景减除获得的运动区域; 为通过多帧混合差分获得的运动区域。

为通过多帧混合差分获得的运动区域。 得到的运动区域除包含运动目标外,还包含虚假目标,

得到的运动区域除包含运动目标外,还包含虚假目标, 得到的运动区域一般比真实目标大,故将

得到的运动区域一般比真实目标大,故将 与

与 进行交运算,得到

进行交运算,得到 ;

; 包含运动目标,与真实运动区域大小相近。然而该运动区域除包含运动目标外,还包含高频背景运动(如波动的水面,摇摆的树枝等)。对

包含运动目标,与真实运动区域大小相近。然而该运动区域除包含运动目标外,还包含高频背景运动(如波动的水面,摇摆的树枝等)。对 做连通性分析,连通面积超过阈值的区域被视为运动目标,归入

做连通性分析,连通面积超过阈值的区域被视为运动目标,归入 ;连通面积小于阈值的区域被视为高频背景区域,从

;连通面积小于阈值的区域被视为高频背景区域,从 中去除。消除高频背景运动的

中去除。消除高频背景运动的 就是最终的背景更新掩模图像,使用

就是最终的背景更新掩模图像,使用 对背景模型进行自适应更新,这样建立的背景模型可以有效地抑制高频背景运动以及图像传感器本身带来的噪声信号。

对背景模型进行自适应更新,这样建立的背景模型可以有效地抑制高频背景运动以及图像传感器本身带来的噪声信号。

3. 运动目标跟踪

运动目标跟踪是将当前检测到的运动目标与之前检测到的运动目标进行匹配。运动目标跟踪与目标的位置、大小、形状以及颜色的分布模型有关。因此,本文在为运动目标建立位置、大小、形状以及颜色匹配度函数的基础上,利用全局匹配的方法进行运动目标跟踪,提高运动目标跟踪的可靠性。

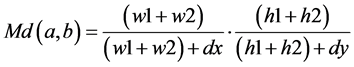

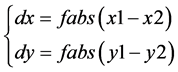

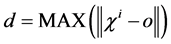

3.1. 位置匹配函数

本文定义运动目标位置匹配度函数为

(12)

(12)

(13)

(13)

式中, 表示运动目标a,

表示运动目标a, 之间的位置接近程度;

之间的位置接近程度; 和

和 分别表示运动目标a的横纵坐标;

分别表示运动目标a的横纵坐标; 和

和 分别表示运动目标

分别表示运动目标 的横纵坐标;

的横纵坐标; 表示运动目标a,

表示运动目标a, 在x方向上的绝对差;

在x方向上的绝对差; 表示运动目标a,

表示运动目标a, 在y方向上的绝对差;

在y方向上的绝对差; 和

和 分别表示运动目标a,

分别表示运动目标a, 宽度的1/2;

宽度的1/2; 和

和 分别表示运动目标a,

分别表示运动目标a, 高度的1/2。

高度的1/2。 的值域在0到1之间,

的值域在0到1之间, 越大,表明运动目标a,

越大,表明运动目标a, 的距离越近;反之,

的距离越近;反之, 越小,表明运动目标a,

越小,表明运动目标a, 距离越远。合并式(12)和式(13),得

距离越远。合并式(12)和式(13),得

(14)

(14)

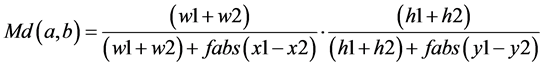

3.2. 大小匹配函数

目标大小在图像中反映为目标中所包含像素数目的多少,目标大小的粗略计算方法可直接求取目标外接矩形面积的大小。然而,对于某些检测出的目标其外接矩形与目标本身的面积大小相差较多,造成计算误差较大,因此本文通过精确计算目标包含像素数目来表示运动目标的大小。运动目标面积匹配程度通常有以下两种表现形式,即

(15)

(15)

(16)

(16)

式中, 表示运动目标a,b之间的面积匹配程度;

表示运动目标a,b之间的面积匹配程度; 表示运动目标

表示运动目标 包含的像素数目;

包含的像素数目; 表示运动目标

表示运动目标 包含的像素数目。

包含的像素数目。 的值域在0到1之间,

的值域在0到1之间, 越大,表明运动目标a,

越大,表明运动目标a, 的大小越接近;反之,

的大小越接近;反之, 越小,表明运动目标a,

越小,表明运动目标a, 的大小差别越大。式(15)和式(16)都可以表示运动目标a,

的大小差别越大。式(15)和式(16)都可以表示运动目标a, 之间的面积匹配程度,本文采用式(15)的计算方法。

之间的面积匹配程度,本文采用式(15)的计算方法。

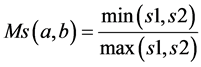

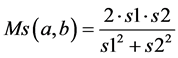

3.3. 形状匹配函数

本文结合运动目标面积周长比和运动目标长宽比来描述运动目标的形状。

定义运动目标面积周长比匹配度函数为

(17)

(17)

式中, 表示运动目标面积周长比匹配度;

表示运动目标面积周长比匹配度; 和

和 分别表示目标a,

分别表示目标a, 包含的像素数目;

包含的像素数目; 和

和 分别表示目标a,

分别表示目标a, 的周长。

的周长。

定义运动目标长宽比匹配度函数为

(18)

(18)

式中, 表示运动目标长宽比匹配度;

表示运动目标长宽比匹配度; 和

和 分别表示运动目标a,

分别表示运动目标a, 宽度的1/2;

宽度的1/2; 和

和 分别表示运动目标a,

分别表示运动目标a, 高度的1/2。

高度的1/2。

定义运动目标形状匹配度函数为

(19)

(19)

式中, 表示运动目标a,

表示运动目标a, 之间的形状相似程度;c为加权常数因子,通常取值0.5。

之间的形状相似程度;c为加权常数因子,通常取值0.5。 的值域在0到1之间,

的值域在0到1之间, 越大,表明运动目标a,

越大,表明运动目标a, 之间的形状越相似;反之,

之间的形状越相似;反之, 越小,表明运动目标a,

越小,表明运动目标a, 之间的形状越不相似。

之间的形状越不相似。

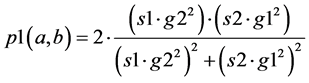

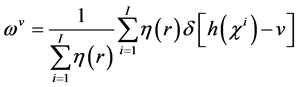

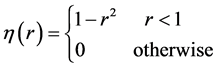

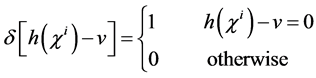

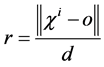

3.4. 颜色匹配函数

建立目标颜色直方图模型的传统方法是直接统计运动目标在每一个像素值包含像素点的数目。该方法简单,基本能反映出目标的颜色分布情况,但实际视频中检测到的目标边缘是不准确的,即有些边缘像素点实际上并不属于运动目标,而属于背景图像,在利用传统目标颜色直方图模型进行目标跟踪时,导致目标跟踪的可靠性降低。因此,本文对传统颜色直方图模型进行改进,提出加权颜色直方图模型,即在建立颜色直方图模型时,对远离目标中心的像素点取较小的权值,对靠近目标中心的像素点取较大的权值,获得改进后的颜色直方图模型 为

为

(20)

(20)

(21)

(21)

(22)

(22)

(23)

(23)

(24)

(24)

(25)

(25)

式中, 表示

表示 的第

的第 个分量,即像素值为

个分量,即像素值为 的像素点在整个目标中所占的比重;

的像素点在整个目标中所占的比重; 表示该目标包含的像素点总数;

表示该目标包含的像素点总数; 为权重函数,远离目标中心的像素点权重较小,靠近目标中心的像素点权重较大;

为权重函数,远离目标中心的像素点权重较小,靠近目标中心的像素点权重较大;

为归一化因子,以确保

为归一化因子,以确保 ;

; 为狄拉克函数,表示

为狄拉克函数,表示 仅统计像素值为

仅统计像素值为 的像素点;

的像素点; 表

表

示目标中第 个像素点;

个像素点; 为

为 的像素值;

的像素值; 表示目标中心点;

表示目标中心点; 表示

表示 与

与 之间的距离;

之间的距离; 表示

表示 的最大值,即目标的半径;

的最大值,即目标的半径; 为

为 与

与 的比值;

的比值; 和

和 分别表示中心点

分别表示中心点 的横纵坐标。

的横纵坐标。

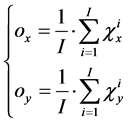

颜色直方图相似度的计算方法为

(26)

(26)

式中, ,

, 为待匹配的两个颜色直方图;m为直方图的维数;

为待匹配的两个颜色直方图;m为直方图的维数; 和

和 分别为

分别为 和

和 的第

的第 个分量。

个分量。 越大,两个直方图越相似,如果

越大,两个直方图越相似,如果 ,则说明两个直方图完全相同。

,则说明两个直方图完全相同。

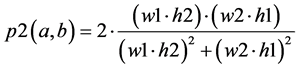

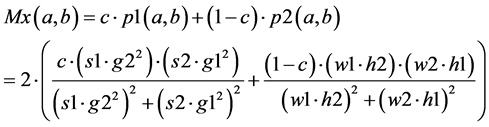

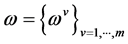

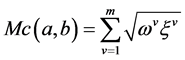

3.5. 全局匹配函数

全局匹配过程就是将当前帧中获取的运动目标与前一段时间内获取的所有运动目标进行匹配的过程,如果匹配成功,则该目标为先前目标;否则,如果匹配失败,则该目标将为新目标,而两个目标是否匹配主要与目标的位置、大小、形状和颜色有关,因此建立运动目标全局匹配的相似度函数为

(27)

(27)

式中,a和 为待匹配的两个目标;

为待匹配的两个目标; 表示表示目标a和目标

表示表示目标a和目标 中心位置的接近程度;

中心位置的接近程度; 表示表示目标

表示表示目标 和目标

和目标 包含像素点总数的接近程度;

包含像素点总数的接近程度; 表示目标

表示目标 和目标

和目标 的形状接近程度;

的形状接近程度; 表示表示目标

表示表示目标 和目标b颜色直方图的相似程度;

和目标b颜色直方图的相似程度; 、

、 、

、 和

和 分别为

分别为 、

、 、

、 和

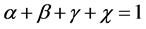

和 的加权系数;且满足

的加权系数;且满足 。

。 的值域在0到1之间,

的值域在0到1之间, 越大,表明运动目标

越大,表明运动目标 ,

, 的匹配度越大;反之,

的匹配度越大;反之, 越小,表明运动目标a,b的匹配度越小。

越小,表明运动目标a,b的匹配度越小。

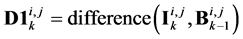

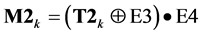

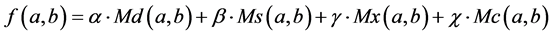

3.6. 运动目标全局跟踪

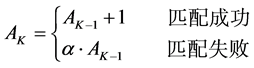

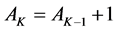

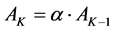

运动目标跟踪的原理框图如图2所示。设当前帧中所有运动目标构成的集合为当前目标集;此前一段时间内所有活力目标构成的集合为先前目标集,利用全局匹配函数在当前目标集和先前目标集中选取最优匹配对,若匹配值超过阈值,则匹配成功,增加该目标的活力值,继续进行下一匹配;反之,若匹配值低于阈值,则匹配失败,降低该目标的活力值。如果目标的活力值低于某一门限,则删除该目标。定义目标活力函数为

(28)

(28)

式中, 表示目标当前帧的活力值,

表示目标当前帧的活力值, 表示目标上一帧的活力值,

表示目标上一帧的活力值, 表示活力衰减因子,

表示活力衰减因子, ;当目标匹配成功时,目标活力增加,

;当目标匹配成功时,目标活力增加, ;反之,当目标匹配失败时,目标活力降低,

;反之,当目标匹配失败时,目标活力降低, 。

。

4. 实验结果与分析

实验采用Intel(R)Core(TM)2Quad CPU作为核心处理器,计算机主频为2.83 GB,4 GB内存。目标视频为实时采集的RGB三通道图像序列,图像分辨率为352 × 288,采样频率为每秒25帧。采用简单背景建模法、单高斯背景建模法、混和高斯背景建模法、卡尔曼滤波背景建模法和本文的建模法分别进行背景建模,利用背景建模结果对实时视频中的运动目标进行检测与跟踪。

Figure 2. Schematic diagram of object tracking

图2. 目标跟踪原理框图

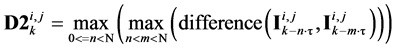

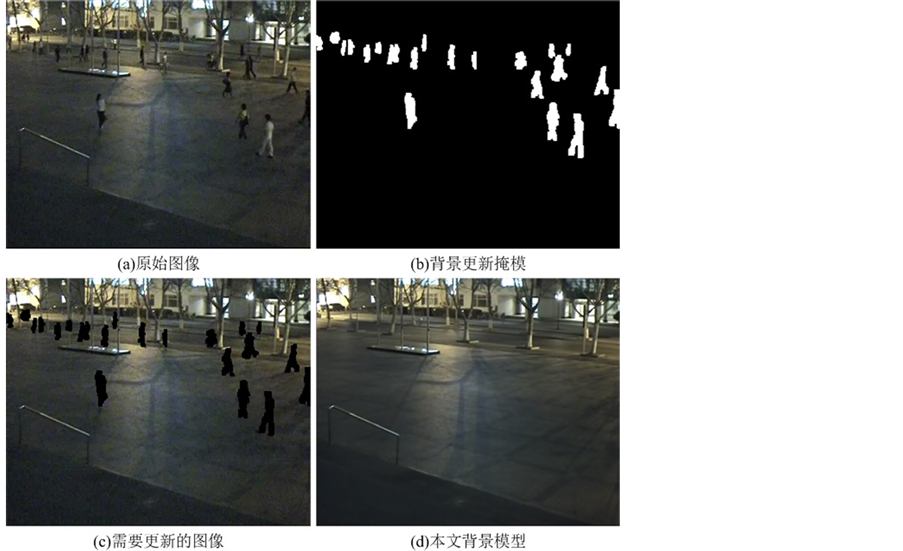

4.1. 背景建模

背景模型建立过程的示意图如图3所示。图3(a)为采集到的当前帧图像;图3(b)为采用本文自适应方法获取的背景更新掩模图像,黑色区域为更新区域,白色区域为非更新区域;图3(c)为需要更新的图像,非全黑区域为更新区域,将这部分区域更新到背景中;图3(d)为本文方法建立的背景模型。

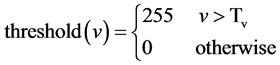

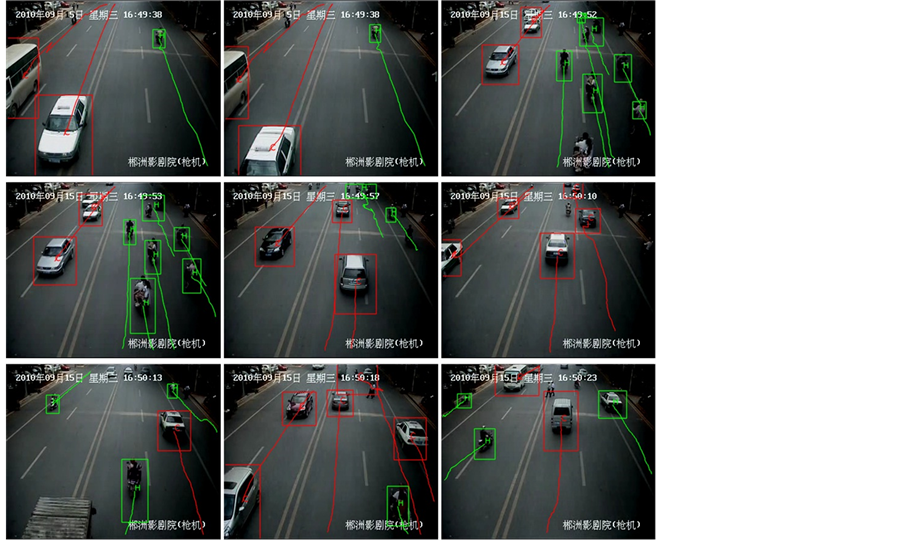

4.2. 多运动目标跟踪

在图4中,运动目标4、5、6在第一张图片中分别沿不同的方向运动,在第2张图片中目标4与目标6发生融合,第三张图片时,目标4与目标6分裂,目标5与目标6融合,直至第四张图片时,目标

Figure 3. Adaptive background modeling

图3. 自适应背景建模

Figure 4. Multi-objects tracking No. 1

图4. 多运动目标跟踪1 5与目标6分裂。本文算法实现了运动目标的正确跟踪。

在图5中,实验选取某公路摄像头实际拍摄视频画面,算法对公路上的车辆、行人进行了连续跟踪,实现了复杂场景下良好的跟踪效果。

Figure 5. Multi-objects tracking No. 2

图5. 多运动目标跟踪2

5. 结论

为提高实时运动目标跟踪的精确性和稳定性,提出了一种基于自适应背景建模的运动目标检测与跟踪算法,与传统方法相比,本文算法具有以下明显优点。

1) 实时建立了一种自适应背景模型,在减少计算量的同时,真实还原了运动目标的背景图像;

2) 建立了运动目标的位置、大小、形状以及颜色分布模型,构造了运动目标全局匹配函数,结合运动目标的活力特征,实现了多运动目标连续稳定跟踪。对于非刚性运动目标的形变、扭曲、旋转,多运动目标彼此遮挡等复杂环境具有较强的鲁棒性。

参考文献 (References)

- [1] Li, D.W., Xu, L.H. and Goodman, E.D. (2013) Illumination-robust foreground detection in a video surveillance system. IEEE Transactions on Circuits and Systems for Video Technology, 23, 1637-1650.

- [2] Afonso, M.V., Nascimento, J.C. and Marques, J.S. (2014) Automatic estimation of multiple motion fields from video sequences using a region matching based approach. IEEE Transactions on Multimedia, 16, 1-14.

- [3] Cuevas, C. and Garcia, N. (2013) Efficient moving object detection for lightweight applications on smart cameras. IEEE Transactions on Circuits and Systems for Video Technology, 23, 1-14.

- [4] Sakaino, H. (2013) Video-based tracking, learning, and recognition method for multiple moving objects. IEEE Transactions on Circuits and Systems for Video Technology, 23, 1661-1674.

- [5] Benosman, R., Ieng, S.-H., Clercq, C., Bartolozzi, C. and Srinivasan, M. (2012) Asynchronous frameless event-based optical flow. Neural Networks, 27, 32-37.

- [6] Salmen, J., Caup, L. and Igel, C. (2011) Real-time estimation of optical flow based on optimized Haar wavelet features. Proceedings of the 6th International Conference on Evolutionary Multi-Criterion Optimization, Ouro Preto, 5-8 April 2011.

- [7] Liu, R.M. and Yang, M. (2011) Tracking multiple feature in infrared image with mean-shift. Proceedings of the 7th International Conference on Advanced Intelligent Computing, Zhengzhou, 11-14 August 2011.

- [8] 蔺海峰, 马宇峰, 宋涛 (2010) 基于SIFT特征目标跟踪算法研究. 自动化学报, 8, 1204-1208.

- [9] Liu, Z., Feng, G.Y. and Hu, D.W. (2012) Robust mean shift tracking with background information. Proceedings of the 9th International Conference on Advances in Neural Networks, Shenyang, 11-14 July 2012.

- [10] Wang, Z.H. and Hong, K. (2013) A new approach for adaptive background object tracking based on Kalman filter and mean shift. Proceedings of the 2013 Research in Adaptive and Convergent Systems, Montreal, 1-4 October 2013.

- [11] Ortegon-Aguilar, J. and Bayro-Corrochano, E. (2007) Particle filter tracking without dynamics. Applied Bionics and Biomechanics, 4, 169-177.

- [12] Karasulu, B. and Korukoglu, S. (2012) Moving object detection and tracking by using annealed background subtraction method in videos: Performance optimization. Expert Systems with Applications: An International Journal, 39, 33-43.

- [13] 梁华 (2009) 多摄像机视频监控中运动目标检测与跟踪. 博士论文, 国防科技大学, 长沙.

- [14] Hoseinnezhad, R., Vo, B.-N. and Vu, T.N. (2011) Visual tracking of multiple targets by multi-bernoulli filtering of background subtracted image data. Proceedings of the Second international conference on Advances in Swarm Intelligence, Chongqing, 12-15 June 2011.