Journal of Security and Safety Technology

Vol.

11

No.

04

(

2023

), Article ID:

76513

,

5

pages

10.12677/JSST.2023.114005

基于YOLOv5的矿工安全帽佩戴及自救器携带检测研究

徐明智1,幸贞雄1,武熠明1,徐翔1,蔡永成2

1贵州省劳动保护科学技术研究院,贵州 遵义

2贵阳红鸟智能技术服务有限公司,贵州 贵阳

收稿日期:2023年10月24日;录用日期:2023年11月24日;发布日期:2023年12月5日

摘要

为增强矿山工作人员佩戴安全帽和携带自救器的意识,有效预防生产安全事故发生,基于Pytorch框架和YOLOv5目标检测算法,实现了对安全帽和自救器的自动检测。结果显示:模型对安全帽和自救器有较高的检测精度,mAP达到84.1%。使用矿山企业现场的监控录像对模型进行测试,能够准确检测到视频中的安全帽和自救器。

关键词

安全管理,安全帽检测,自救器检测,计算机视觉,YOLOv5

Research on Miners’ Helmet Wearing and Self-Rescuer Carrying Detection Based on YOLOv5

Mingzhi Xu1, Zhenxiong Xing1, Yiming Wu1, Xiang Xu1, Yongcheng Cai2

1Guizhou Institute of Labor Protection Science and Technology, Zunyi Guizhou

2Guiyang Red Bird Intelligent Technology Service Co., Ltd., Guiyang Guizhou

Received: Oct. 24th, 2023; accepted: Nov. 24th, 2023; published: Dec. 5th, 2023

ABSTRACT

To enhance the awareness of mine workers to wear safety helmets and carry self-rescuers, and effectively prevent production safety accidents, automatic detection of safety helmets and self- rescuers was realized based on the Pytorch framework and YOLOv5 target detection algorithm. The results show that the model has high detection accuracy for safety helmets and self-rescuers, and the mAP reaches 84.1%. The model was tested using surveillance video from the site of a mining enterprise and was able to accurately detect helmets and self-rescuers in the video.

Keywords:Safety Management, Helmet Detection, Self-Rescuer Detection, Computer Vision, YOLOv5

Copyright © 2023 by author(s) and Hans Publishers Inc.

This work is licensed under the Creative Commons Attribution International License (CC BY 4.0).

http://creativecommons.org/licenses/by/4.0/

1. 引言

我国是一个矿产资源大国,矿种比较齐全,截至2021年底,全国已发现矿产173种 [1] 。尽管我国的矿产储存总量较大,但有着贫矿多、富矿少,伴生矿多、独立矿少等特点,因此开发利用难度较大,此外,我国地质条件相对复杂,矿山企业环境条件、设备状态、从业人员安全素养和管理水平等参差不齐 [2] [3] ,安全风险高,因此,矿山的安全形势并不乐观,矿山安全也一直是国家的重点监管对象。

人的不安全行为是导致事故的主要原因之一,有研究表明超过70%的生产安全事故与员工的不安全行为有关 [4] ,部分矿工由于安全意识不强,在采矿作业中可能会出现麻痹大意或是觉得不够舒适,不正确穿戴劳保用品,将自己置于危险中,及时发现和纠正这些不安全行为,可以有效预防事故发生。传统的人工检查方式有着监管效率低、时效性不足等缺点,随着我国步入智能化发展阶段,人工智能技术越来越多的出现在人们的生活和工作中,人们开始探索“无人”监管的模式 [5] ,利用人工智能技术实现矿山企业生产过程中不安全行为的智能监测预警,成为了当前矿山安全管理的一个重要研究方向 [6] [7] 。

佩戴安全帽和携带自救器可以给矿山工作人员提供保护,是进入矿井工作的必备条件。安全帽能够对头部起到较强的保护作用,它不仅能够承受和分散坠落的石头、工具等硬物的冲击力,并且可以一定程度上减轻佩戴者在高处坠落时头部受到撞击伤害;自救器是用于危险环境下防止有中毒和窒息的一种呼吸保护器具,在缺氧或场所中充斥有毒有害时,能够为工作人员提供必要的氧气,起到减少人员伤亡、为救援赢得宝贵时间的作用。因此,及时检测到未佩戴安全帽或未携带自救器行为,对于保护矿山工作人员生命安全有十分重要的意义。目前已经有许多安全帽佩戴自动检测的研究,取得了不错的成果 [8] [9] [10] ,但对于检测自救器方面的研究还比较少。

2. 相关技术简介

针对自救器检测研究成果较少这一现状,文章以矿山作业为场景,利用PyTorch框架搭建YOLOv5算法模型,实现矿工安全帽佩戴和自救器携带情况的自动检测。通过部署服务器和算法模型,并进行相应的配置,可以自动分析矿山作业区域的监控视频,检测该区域内的矿工是否佩戴安全帽或携带自救器,输出带有标注的检测结果。

2.1. YOLOv5算法

计算机视觉是人工智能当前的一个重要研究方向,而目标检测技术属于计算机视觉一个分支,其目的是在图像或视频中找到感兴趣的目标对象。目标检测算法通常分为单阶段(one-stage)和双阶段(two-stage)两类,双阶段目标检测算法的代表有R-CNN、SPPNet、Fast-RCNN、Faster-RCNN等,其检测精度较高,但训练和检测时间较长,YOLO系列和SSD、FSSD等单阶段目标检测算法以损失部分精度为代价,极大的提升了检测速度,并且随着研究的不断深入,检测性能也越来越强。

YOLOv5是Ultralytics公司发布的轻量级单阶段目标检测算法 [11] [12] ,有检测度快、准确率高、模型体积小、易于部署使用的优点,被广泛使用在安防、交通、医疗等各种行业中。YOLOv5网络结构主要有4个部分,分别是Input (输入端)、Backbone (主干网络)、Neck (多尺度特征融合网络)和Prediction (输出端)。输入端使用了Mosaic数据增强方式、自适应锚框计算、自适应图片缩放等技术,对输入图片进行预处理;主干网络用于提取图片特征,主要由Focus结构和CSP结构组成;多尺度特征融合网络包含FPN和PAN模块,用于融合浅层图形特征和深层语义特征;输出端使用CIOU_Loss做Bounding box的损失函数,提高了预测框回归的速度和精度。

2.2. Pytorch框架

深度学习框架是将繁琐、复杂的底层硬件调用方式进行模块化封装的一类软件,它的出现降低了深度学习算法的学习和使用门槛,使用者只需使用简洁的功能函数,就可以快速完成算法搭建、训练和测试,极大提高了工作效率。

目前主流的深度学习框架有Tensor Flow、PyTorch、Paddle Paddle、Theano、CNTK等 [13] [14] 。文章采用的PyTorch是Facebook人工智能研究院开发的一款深度学习框架,其提供了Python接口,同时具有较好的灵活性和强大的GPU加速,易于学习和使用。PyTorch拥有一个庞大的交流社区,社区中提供了许多开源的项目和库,能够帮助使用者更快构建深度学习模型。近几年,PyTorch凭借其易用性在研究领域和各类小项目设计应用中崭露头角,发展迅速。

3. 实验与测试结果

3.1. 数据集制作

数据集的优劣会直接影响模型的训练效果,现存的开源安全帽数据集SHWD (safely helmet wearing dataset)中多数场景与矿山的实际情况不符,未佩戴安全帽的图片包含了很多学生上下课以及街上行人的数据,此外,自救器目前也没有相关的公开数据集,因此,本次实验采用了自制数据集。

实验使用的图片中包含了安全帽、未佩戴安全帽(标注未佩戴安全帽的头部)、自救器三个类别,来源矿山企业的监控录像视频,通过裁剪和筛选后,最终获得图片20984张。使用精灵标注助手对素材图片进行标注,标注信息以JSON格式进行存储,按照9:1的比例将数据集分为训练集和测试集。

3.2. 模型训练情况

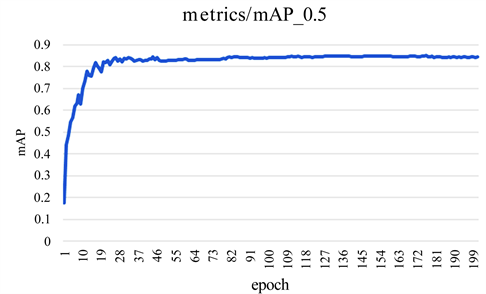

本次实验使用的设备参数如表1所示,初始学习率设置为0.01,batch_size为32,训练轮次为200轮,模型的mAP曲线和性能指标如图1和表2所示。

Table 1. Experimental equipment parameters

表1. 实验设备参数

Figure 1. mAP curve of model

图1. 模型mAP曲线

Table 2. Model performance indicators

表2. 模型性能指标

图1为佩戴安全帽、未佩戴安全帽、自救器三个类别模型训练的mAP曲线,可以看到最终模型的mAP趋于稳定。此外,表2中模型检测安全帽和自救器都具有较好的效果,检测未佩戴安全帽时检测效果稍差,主要是因为制作数据集时采集的视频来自于矿山企业生产场所附近,该区域中未佩戴安全帽的人员很少,素材丰富程度不足。此外,该地人员数量较多,视频中常出现的彼此重合、头部被大面积遮挡的情况也增加了检测难度。

3.3. 现场测试

为反映检测佩戴安全帽和携带自救器情况的模型在矿山企业生产现场的实际应用效果,使用矿山企业现场的视频进行测试,图2为部分测试结果。可以看出,模型在单目标和多目标情况下都具有较好的检测效果,能够检测出视频中人员佩戴的安全帽和携带的自救器。

Figure 2. Video testing effect on site

图2. 现场视频测试效果

4. 结论

针对矿山行业的安全帽佩戴和自救器携带监管困难的问题,利用了Pytorch框架搭建了YOLOv5算法,采集矿山企业员工佩戴安全帽和携带自救器的图像样本进行模型训练,模型的mAP达到84.1%,具有较好的检测效果。使用矿山企业生产现场的监控视频进行测试,测试结果表明,该模型能够检测到现场的安全帽佩戴和自救器携带情况,可以一定程度上替代传统的人工监管方式,提高监管效率。

基金项目

贵州省科研机构创新能力建设专项资金(黔科合服企[2020] 4014)。

文章引用

徐明智,幸贞雄,武熠明,徐 翔,蔡永成. 基于YOLOv5的矿工安全帽佩戴及自救器携带检测研究

Research on Miners’ Helmet Wearing and Self-Rescuer Carrying Detection Based on YOLOv5[J]. 安防技术, 2023, 11(04): 41-45. https://doi.org/10.12677/JSST.2023.114005

参考文献

- 1. 中华人民共和国自然资源部. 中国矿产资源报告2022[M]. 北京: 地质出版社, 2022.

- 2. “十四五”矿山安全生产规划[J]. 中国安全生产, 2022, 17(10): 5.

- 3. 李贤功, 宋学锋, 张明慧, 等. 矿山安全态势预测预警研究[J]. 工矿自动化, 2021, 47(5): 35-39+111.

- 4. 刘林, 梅强, 常志朋. 国内70年来员工不安全行为研究: 发展阶段、研究热点及趋势分析[J]. 中国安全科学学报, 2021, 31(3): 1-12.

- 5. 李红霞, 樊恒子, 陈磊, 等. 智慧矿山工人不安全行为影响因素模糊评价[J]. 矿业研究与开发, 2021, 41(1): 39-43.

- 6. 原志明. 上湾煤矿安全智能视频系统设计及应用[J]. 煤炭科学技术, 2017, 45(S2): 114-117.

- 7. 张楠. 矿井巷道掘进作业智能监测及安全预警系统设计[J]. 机电工程技术, 2019, 48(8): 227-229.

- 8. 郭师虹, 井锦瑞, 张潇丹, 等. 基于改进的YOLOv4安全帽佩戴检测研究[J]. 中国安全生产科学技术, 2021, 17(12): 135-141.

- 9. 宋晓凤, 吴云军, 刘冰冰, 等. 改进YOLOv5s算法的安全帽佩戴检测[J]. 计算机工程与应用, 2023, 59(2): 194-201.

- 10. 杨莉琼, 蔡利强, 古松. 基于机器学习方法的安全帽佩戴行为检测[J]. 中国安全生产科学技术, 2019, 15(10): 152-157.

- 11. Glenn, J. (2020) Ultralyt-ics/YOLOv5: v3.1-Bug Fixes and Performance Improvements. https://github.com/ultralytics/yolov5

- 12. 邵延华, 张铎, 楚红雨, 等. 基于深度学习的YOLO目标检测综述[J]. 电子与信息学报, 2022, 44(10): 3697-3708.

- 13. 薛晨兴. 国内外深度学习框架分析与研究[J]. 电子元器件与信息技术, 2023, 7(5): 66-71+87.

- 14. 黄玉萍, 梁炜萱, 肖祖环. 基于TensorFlow和PyTorch的深度学习框架对比分析[J]. 现代信息科技, 2020, 4(4): 80-82+87.