Computer Science and Application

Vol.07 No.06(2017), Article ID:21018,8

pages

10.12677/CSA.2017.76061

Person Re-Identification System Design and Implementation Based on Camera Network

Kai Huang1, Xinyu Wang2, Hua Yang2

1Science and Technology Division of Shanghai Municipal Public Security Bureau, Shanghai

2Shanghai Jiao Tong University, Shanghai

Received: May 30th, 2017; accepted: Jun. 16th, 2017; published: Jun. 19th, 2017

ABSTRACT

According to the demands on city public security video surveillance for person re-identification, we first analyze the value of a person re-identification software system for video surveillance system and then analyze the advanced research development in person re-identification. Furthermore, we design a software system by combining appearance and biological feature for person re-identification. Finally we conduct the online test of the software system and obtain the good performance.

Keywords:Video Surveillance, Person Re-Identification, Software System

基于监控摄像机网络的行人比对系统设计和实现

黄 凯1,王新宇2,杨 华2

1上海市公安局科技处,上海

2上海交通大学,上海

收稿日期:2017年5月30日;录用日期:2017年6月16日;发布日期:2017年6月19日

摘 要

本文主要从面向公安图像监控的行人重识别的应用需求出发,首先分析面向视频监控应用的行人重识别软件系统的价值,然后归纳总结当前国内外在行人重识别领域的研究框架和思路,分析选择了生物特征与行人外观特征相结合的方法,并对该行人重识别算法进行软件系统的设计开发。算法经过实际监控场景的数据测试评估,准确性和运行效率达到较好的效果。

关键词 :视频监控,行人重识别,软件系统

Copyright © 2017 by authors and Hans Publishers Inc.

This work is licensed under the Creative Commons Attribution International License (CC BY).

http://creativecommons.org/licenses/by/4.0/

1. 背景介绍

对城市安全和社会稳定具有重要意义的视频监控系统近年来得到了越来越多的关注和越来越快的发展。监控摄像机几乎在城市关键场所都有所布局。监控摄像机拍摄下来的视频和图片是宝贵的信息,这些信息为公安部门进行危险预警,案件侦破提供非常重要的帮助。但是由于视频和图片数量巨大,如何充分利用其信息是一项重要挑战。传统的依靠人力进行视频监控的方法显然不能充分利用这些信息。这是因为人眼在进行长期视频监控过程中会产生视觉疲劳,从而产生一定的错误。其次完全依靠人力进行视频监控对监控人员的精力是一项巨大的消耗。所以辅助工作人员进行视频分析的软件系统是非常必要的。

在工作人员进行视频监控时,在监控摄像头下出现的行人是其更为关注的内容。因此聚焦于行人的视频监控系统开发具有很大的价值。行人重识别可以在多相机视频监控网络下,将同一个行人从不同的监控摄像机下识别出来。行人重识别技术可以将在不同的监控场景下以及在多摄像机网络中拍摄的行人图片之间建立对应关系。通过比对图片可以追踪目标行人对其进行行为分析。这会为搜索目标行人以及对特定事件进行分析提供非常大的助力。

因此一个面向视频监控应用的行人重识别系统是非常有意义的,可以应用在以下场景:

1) 在刑侦事件中,对目标行人的行为分析通常由经验丰富的公安监控人员来完成,但是监控系统拍摄的数据是海量的,通过人力进行目标锁定和案件分析是一件非常低效的事情,对人力也是极大的浪费。利用面向视频监控的行人重识别系统进行行人比对,自动锁定目标行人的位置,将会极大的提高办案效率。

2) 在实时视频监控中,可实时监控目标行人。如果在实时存储的行人数据集图片中可以检索到与目标行人相近的外貌体型特征,可以将目标行人和实时拍摄的行人图片建立联系,提醒视频监控人员,预防危险事件发生。

2. 国内外研究现状

行人重识别在视频监控中是非常重要的问题。尽管目前已经有很多研究聚焦于这一领域,行人重识别依旧面临很多挑战。

一、目前监控场所捕捉到的行人图片分辨率低,提取清晰的生物特征用于行人重识别非常困难。

二、不同的行人在两个摄像机场景出现的时间变化非常大,使用时间和空间限制帮助行人重识别非常困难。

三、仅仅依靠外貌特征用来识别行人并不稳定,因为行人的外貌特征会受到姿态,光照,背景和遮挡的影响。

四、在大型的视频监控网络行人重识别计算效率低也给行人重识别应用带来非常大的挑战。

特征提取和行人比对是行人重识别中的两个研究方向。

特征提取作为行人重识别的基础和关键,提取出具有区别性的可靠特征是非常重要的。目前的特征提取方法分为传统方法和深度学习的方法,传统方法发展至今,已经提出了大量的特征用于行人重识别,比如颜色 [1] [2] ,形状 [3] [4] ,纹理 [5] [6] [7] [8] 等。但是,单一特征受光照变化,遮挡等的严重影响,性能并不好。另一方面,深度学习的方法通过设计网络自适应的模型用于学习行人的特征表达。这种方法近年来得到了很大的应用,尤其是用深度卷积网络(CNN)提取行人的空域特征取得了比较好的效果 [9] [10] [11] [12] 。然而,这类方法同样在行人外貌特征变化很大时,会引发较为严重的过拟合现象,单一地应用提取出的空域特征并不够可靠,此时性能不够理想。目前多特征融合是行人重识别中可以提高识别准确率的一个有效方法。因为单一特征不能强大到捕捉所有行人图片间的细微差别。而融合特征被证实在行人重识别中可以取得较为理想的算法准确率。

行人比对目前主流的方法是基于度量学习 [13] [14] 的比对方法。这种方法通过学习找到最能区分正确行人对和错误行人对的最佳距离度量,用于进行行人比对。度量学习的方法通过对特定场景进行标定训练,会对比对效果有较大提升,但普适性不强,针对新的场景需要进行重新训练,训练标定过程较为复杂,且方法的空间复杂度都较高,目前还很难应用到实际系统中。

3. 系统的设计和实现

目前的行人重识别模块有很多方案可供选择,在选择方案时,我们主要考虑以下两个方面的因素:

算法的准确率。行人重识别算法的准确率主要是指目标行人正确匹配的行人图片在进行相似度排名时排在前面的比例。只有算法准确率高才能被使用。如果正确匹配的行人图片出现在排名的末尾,那么仍然需要消耗极大的人力进行比对。无法起到提高效率的作用。

算法的时间消耗。因为监控摄像机拍摄的图片量极大。因此在实际应用中算法时间消耗是软件设计时需要考虑的问题。如果算法为了高的准确率而消耗了过多时间导致运算过慢,在实际应用中是得不偿失的。

考虑到以上两个因素我们使用了一种分辨率自适应特征提取与融合的行人重识别方法 [15] 。该算法融合了多种特征,在准确率上有一定的保证,并且使用多尺度图片和筛选过程提高了算法的效率。

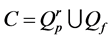

图1是该算法的框架图:算法具体流程如下:

第一步:设  为相机A下的行人图片集合,

为相机A下的行人图片集合,  为相机B下的行人图片集合;

为相机B下的行人图片集合;

第二步:对P和Q中的原始行人图片进行降采样,得到低尺度图片;采用筛选机制,先将行人图片集合Q用HS和HOG筛选,得到筛选后的集合 ,然后在高尺度图片上提取LPQ特征,所述高尺度图片是原始行人图片集合P和Q,在P上能检测出人脸特征的行人图片集合记为

,然后在高尺度图片上提取LPQ特征,所述高尺度图片是原始行人图片集合P和Q,在P上能检测出人脸特征的行人图片集合记为 ,在Q上能检测出人脸特征的行人图片集合记为

,在Q上能检测出人脸特征的行人图片集合记为 ,最后用能检测到人脸的行人图片集合

,最后用能检测到人脸的行人图片集合 来补充候选行人集

来补充候选行人集 ,将候选行人集扩充为C,如式(1)所示。

,将候选行人集扩充为C,如式(1)所示。

(1)

(1)

第三步:在 的原始行人图片上即高尺度图片上提取有空间限制的纹理特征(LSCF),极大稳定颜色区域特征(MSCR)和加权颜色特征(wHSV);

的原始行人图片上即高尺度图片上提取有空间限制的纹理特征(LSCF),极大稳定颜色区域特征(MSCR)和加权颜色特征(wHSV);

第四步:采用自适应加权的方法融合在低尺度和高尺度上提取的特征,针对行人 ,

, ,对行人集合中的各行人进行相似度计算,并对得到的相似度按降序排列。

,对行人集合中的各行人进行相似度计算,并对得到的相似度按降序排列。

综上,本发明方法根据特征在分辨率上的特点,在不同的图像尺度提取特征,然后用颜色、轮廓和人脸特征筛选行人,然后再自适应融合在高尺度和低尺度提取的特征,选出与目标行人最接近的行人;通过生物特征和外貌特征的自适应融合可以提高方法的准确率,通过在低尺度提取外貌特征以及筛选机制可以降低方法复杂度。

确定算法之后,我们设计如下软件框架:

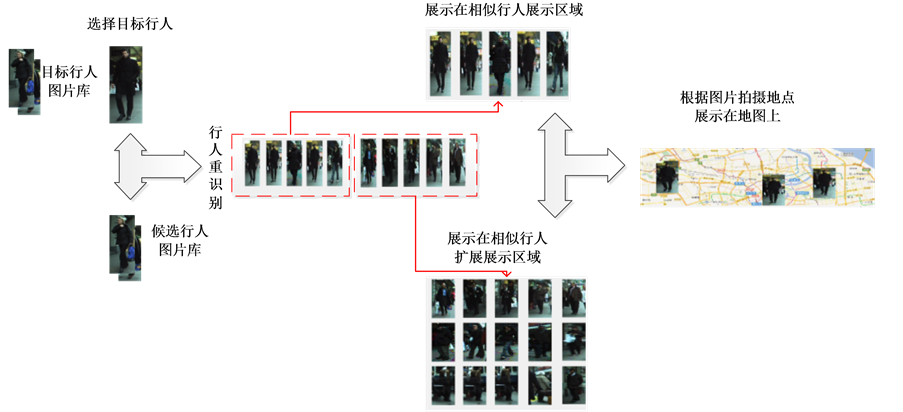

软件系统框架如图2所示。在使用行人重识别算法进行行人行为分析时首先要选择目标行人,在选择目标行人后运行行人重识别算法,底层算法会对数据库中的行人图片按照和目标行人的相似程度进行排序,然后将其展示在相似行人展示区域,通常我们只显示前5个最相似的行人,如果目标行人没有出

Figure 1. Recognition algorithm of resolution adaptive pedestrian

图1. 分辨率自适应的行人重识别算法 [15]

Figure 2. Design architecture diagram of pedestrian recognition software system

图2. 行人重识别软件系统设计架构图

现在前5名,继续进入相似行人扩展区域查看后续排名的相似行人。在进行候选行人和目标行人比对并按照相似度排名后,点击正确匹配的行人图片,软件会根据图片拍摄地点展示在地图区域,帮助进行行人行为分析。

4. 主要功能和性能

4.1. 主要功能设计及实现

软件使用的开发环境是windows 7硬件平台。硬件参数是Intel i7,3.4 GHz,8G-B RAM。

首先对软件功能模块进行介绍。

1) 选择目标行人模块。行人重识别系统的主要目标是找到与目标行人的相关联图像。软件系统的首要功能是将目标行人图片载入系统。该模块负责完成这一功能。

2) 行人重识别模块。该模块对目标行人进行行人重识别,即在存储的图片库中找到与目标行人最相似的行人图片。

3) 相似行人展示模块。该模块对候选行人图片和目标行人图片的相似程度进行分析,将相似度排名靠前的几张行人图片展示出来。

4) 相似行人扩展展示模块。如果我们想要的行人图片没有出现在相似行人展示模块中,可以在该模块将后续排名的行人图片展示出来。

5) 行人位置分析模块。该模块通过对行人图片拍摄地点解析,将其在地图中展示出来,帮助监控人员进行目标行人行为分析。

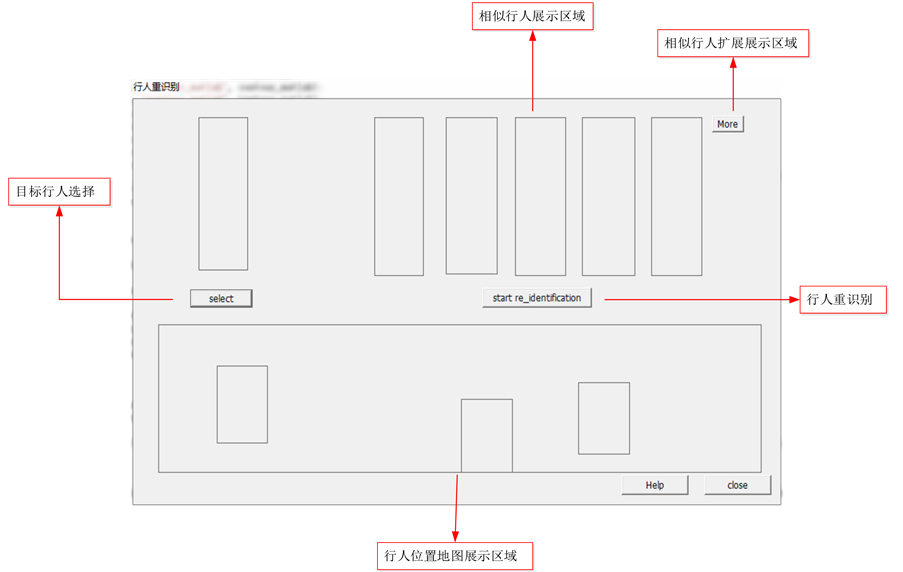

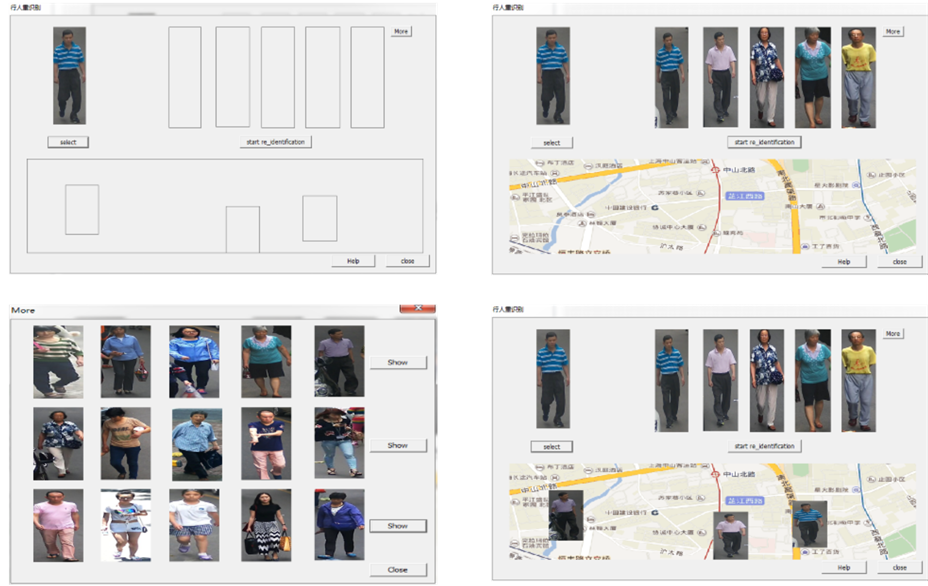

图3是软件的人机交互界面,分别为选择目标行人模块,行人重识别算法后的相似行人展示区域模块,相似候选行人扩展展示区域和行人所在地图位置分析模块。图4是运行软件后的效果图。

Figure 3. Introduction to the software main interface and module

图3. 软件主界面和模块介绍

4.2. 性能测试和验证

测试所使用的数据集是在真实道路监控摄像机下的拍摄的行人图片。选择其中抓拍获取的图片进行行人重识别。利用本文实现的软件系统对多行人对进行比对排序,记录正确比对的行人图片数目。

准确率 = (正确匹配的行人图片数目/进行行人重识别的行人图片总数) × 100%。从表1中我们可以看到我们的行人重识别系统有较为满意的识别准确率。

同时我们还进行了另外一个实验来验证算法的效率。我们将一张目标行人图片和其他83个行人图片进行比对来进行行人重识别。比较了我们集成的算法有筛选和无筛选的两种情况,其中无筛选可以认为筛选系数为0的一种特殊情况。我们将计算消耗的时间展示在表2中,通过实验我们可以看到算法经过筛选过程效率有了一定程度的提高。

Figure 4. Online display of software features

图4. 软件功能在线展示

Table 1. Test results of algorithm performance

表1. 算法性能测试结果

Table 2. The comparison of the operating efficiency of algorithm realization

表2. 实现算法的运行效率的比较

5. 总结

根据视频监控实际应用需求,本文设计和开发了面向视频监控应用的行人重识别系统。本系统采用多种特征融合的算法方案,并结合了人脸生物特征和图像的外观特征,使得行人重识别的准确率大大提高。设计开发软件在使用方法上简单易行,操作方便。另外在软件运行效率上,本系统使用的算法具有筛选的过程,并且提取特征在多尺度图像上进行,减少了特征提取和特征比对带来的时间消耗,使运行效率获得了提升。本文研究系统可有效帮助监控人员进行行人布控和排查分析,对提高公安相关业务处理效率具有重要的作用。

文章引用

黄 凯,王新宇,杨 华. 基于监控摄像机网络的行人比对系统设计和实现

Person Re-Identification System Design and Implementation Based on Camera Network[J]. 计算机科学与应用, 2017, 07(06): 499-506. http://dx.doi.org/10.12677/CSA.2017.76061

参考文献 (References)

- 1. Bazzani, L., Cristani, M. and Murino, V. (2013) Symmetry-Driven Accumulation of Local Features for Human Characterization and Re-Identification. Computer Vision and Image Understanding, 117, 130-144. https://doi.org/10.1016/j.cviu.2012.10.008

- 2. Kviatkovsky, I., Adam, A. and Rivlin, E. (2013) Color Invariants for Person Reidentification. IEEE Transactions on Pattern Analysis and Machine Intelligence, 35, 1622-1634. https://doi.org/10.1109/TPAMI.2012.246

- 3. Oreifej, O., Mehran, R. and Shah, M. (2010) Human Identity Recognition in Aerial Images. Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, San Francisco, 13-18 June 2010, 709-716. https://doi.org/10.1109/cvpr.2010.5540147

- 4. Schwartz, W. and Davis, L. (2009) Learning Discriminative Appearance Based Models Using Partial Least Squares. Brazilian Symposium on Computer Graphics and Image Processing, Rio de Janiero, 11-15 October 2009, 322-329. https://doi.org/10.1109/sibgrapi.2009.42

- 5. Gray, D. and Tao, H. (2008) Viewpoint Invariant Pedestrian Recognition with an Ensemble of Localized Features. In: Forsyth, D., Torr, P. and Zisserman, A., Eds., Computer Vision—ECCV 2008. Lecture Notes in Computer Science, 5302, 262-275.

- 6. Prosser, B., Zheng, W., Gong, S. and Xiang, T. (2010) Person Re-Identification by Support Vector Ranking. Proceedings of the British Machine Vision Conference, London, 5-7 September 2010, 1-11. https://doi.org/10.5244/c.24.21

- 7. Zhang, Y. and Li, S. (2011) Gabor-LBP Based Region Covariance Descriptor for Person Re-Identification. International Conference on Image and Graphics, Hefei, 12-15 August 2011, 368-371. https://doi.org/10.1109/icig.2011.40

- 8. Zhao, R., Ouyang, W. and Wang, X. (2013) Person Re-Identification by Salience Matching. Proceedings of the IEEE International Conference on Computer Vision, Sydney, 1-8 December 2013, 2528-2535. https://doi.org/10.1109/iccv.2013.314

- 9. Ahmed, E., Jones, M. and Marks, T.K. (2015) An Improved Deep Learning Architecture for Person Re-Identification. Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, Boston, 7-12 June 2015, 3908- 3916. https://doi.org/10.1109/cvpr.2015.7299016

- 10. Shi, H., Yang, Y., Zhu, X., Liao, S., Lei, Z., Zheng, W. and Li, S.Z. (2016) Embedding Deep Metric for Person Re-Identification: A Study against Large Variations. In: Leibe, B., Matas, J., Sebe, N. and Welling, M., Eds., Computer Vision—ECCV 2016. Lecture Notes in Computer Science, Springer, Berlin, 732-748. https://doi.org/10.1007/978-3-319-46448-0_44

- 11. Su, C., Zhang, S., Xing, J., Gao, W. and Tian, Q. (2016) Deep Attributes Driven Multi-Camera Person Re-Identifica- tion.

- 12. Zheng, L., Bie, Z., Sun, Y., Wang, J., Su, C., Wang, S. and Tian, Q. (2016) MARS: A Video Benchmark for Large- Scale Person Re-Identification. In: Leibe, B., Matas, J., Sebe, N. and Welling, M., Eds., Computer Vision—ECCV 2016. Lecture Notes in Computer Science, Springer, Berlin, 868-884. https://doi.org/10.1007/978-3-319-46466-4_52

- 13. Zheng, W.S., Gong, S. and Xiang, T. (2011) Person Re-Identification by Probabilistic Relative Distance Comparison. IEEE Conference on Computer Vision & Pattern Recognition, Providence, 20-25 June 2011, 649-656. https://doi.org/10.1109/cvpr.2011.5995598

- 14. Köstinger, M., et al. (2012) Large Scale Metric Learning from Equivalence Constraints. IEEE Conference on Computer Vision and Pattern Recognition (CVPR), Providence, 16-21 June 2012, 2288-2295. https://doi.org/10.1109/cvpr.2012.6247939

- 15. Yang, H., Wang, X., Zhu, J., et al. (2016) Resolution Adaptive Feature Extracting and Fusing Framework for Person Re-identification. Neurocomputing, 212, 65-74. https://doi.org/10.1016/j.neucom.2016.03.096