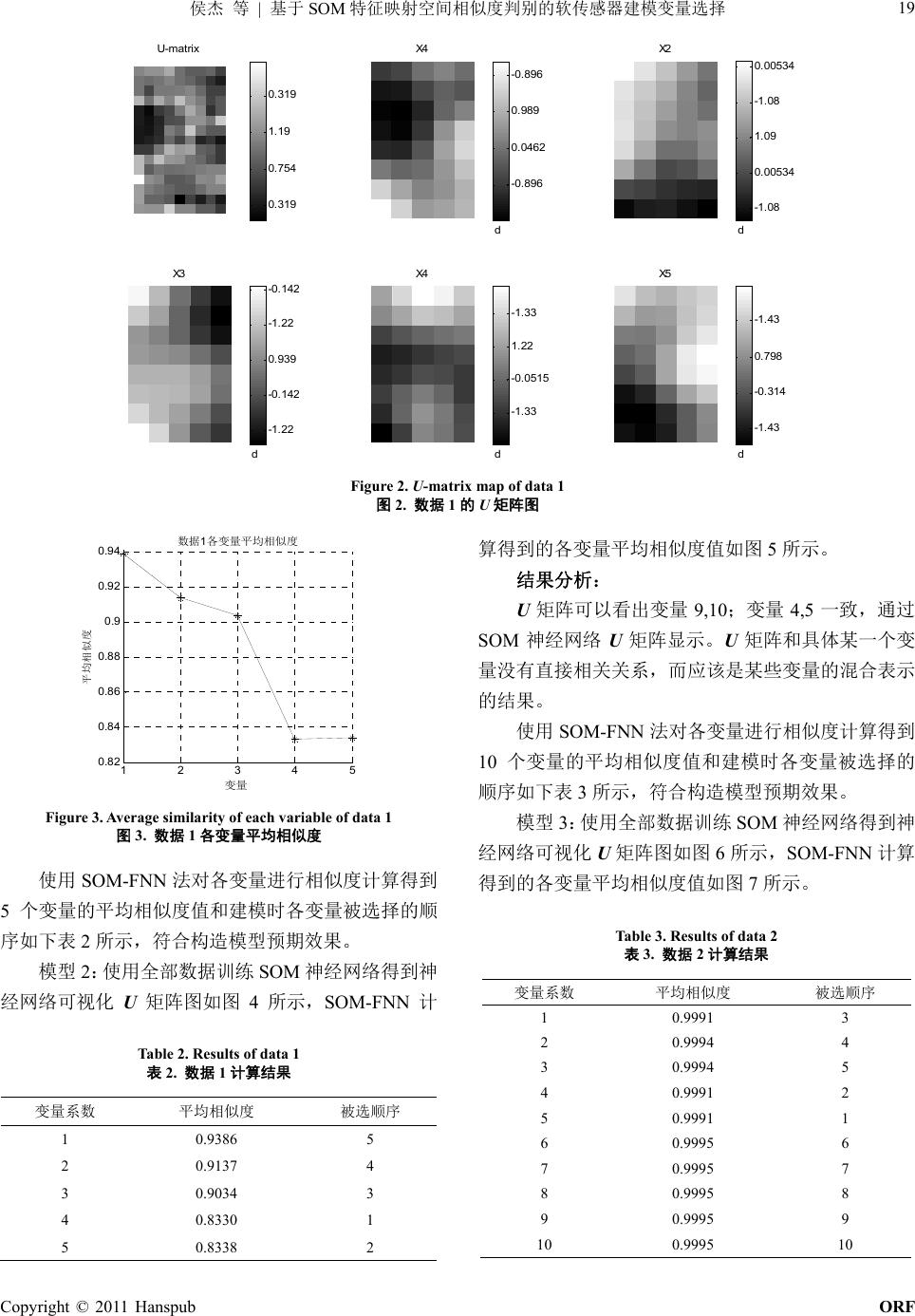

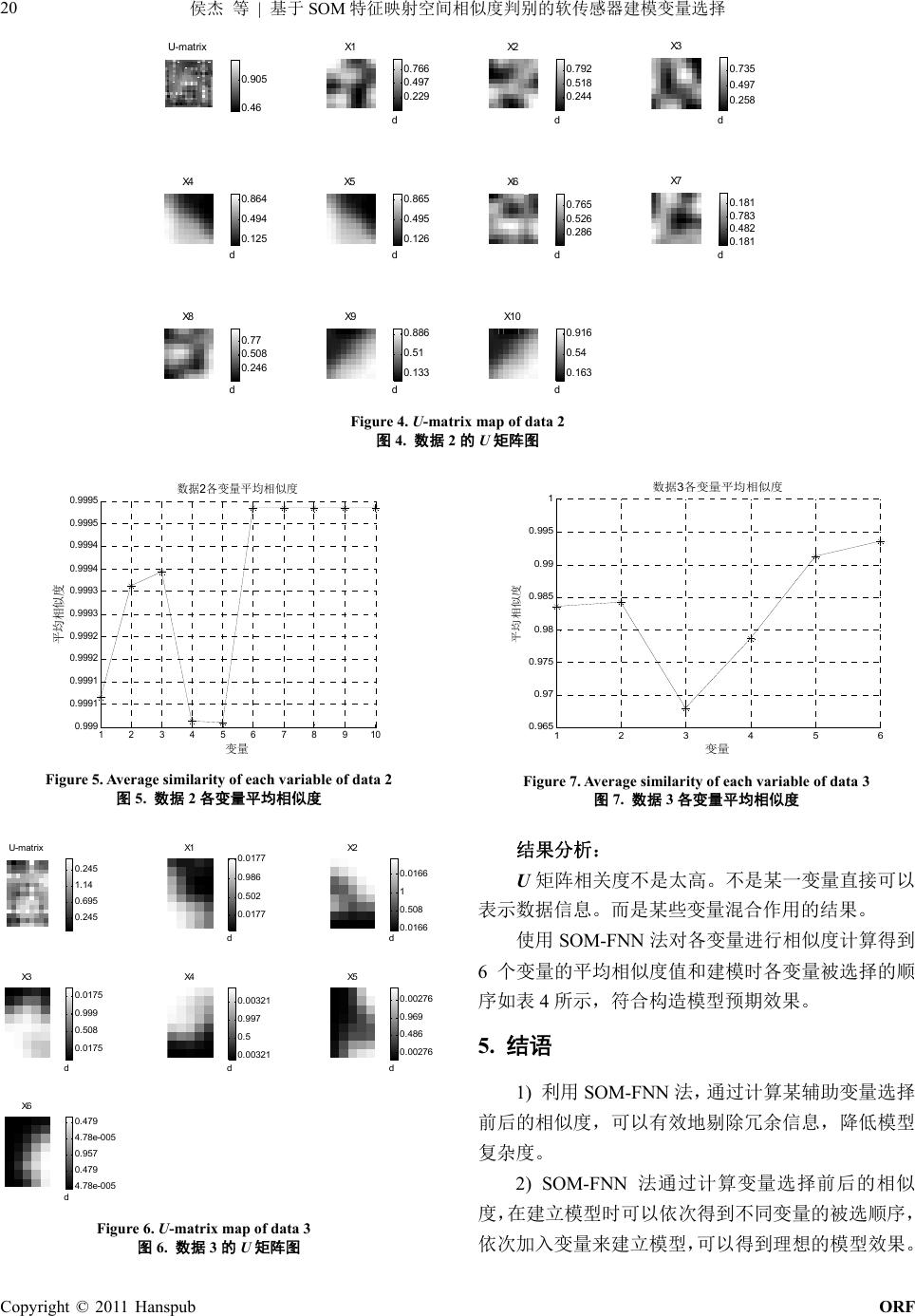

Operations Research and Fuzziology 运筹与模糊学, 2011, 1, 16-21 http://dx.doi.org/10.12677/orf.2011.11004 Published Online August 2011 (http://www.hanspub.org/journal/orf/) Copyright © 2011 Hanspub ORF Variable Selection for Soft-Sensing Model Based on False Nearest Neighbors in Self-Organizing Feature Mapping Feature Space* Jie Hou1, Taifu Li2, Dejun Yu3, Yang Cheng4 1College of Automation, Chongqing University, Chongqing 2Department of Electrical and Information Engineering, Chongqing University of Science and Techn olo g y, Chong q in g 3Chongqing Electric Power College, Chongqing 4Chongqing Academy of Agricultural Sciences, Chongqing Email: ynhj88311@163.com Received: Jun. 20th, 2011; revised: Jul. 5th, 2011; accepted: Jul. 10th, 2011. Abstract: A new variable selection method based on Self-Organizing Feature Mapping (SOM) is proposed for soft-sensing modeling to eliminate redundant information. In the proposed method, SOM is used to get new space from original variable space because of its simple and fast. The False Nearest Neighbor (FNN) is used to calculate the similarity of data in the new SOM space. The primary variable would be estimated to select secondary variables. The results show that the method is effective and suitable for variable selection. Therefore, a new method is provided for the variable selection of soft-sensing modeling. Keywords: Variable Selection; Soft-Sensoring Modeling; Self-Organizing Feature Mapping (SOM); Feature Space; False Nearest Neighbor (FNN) 基于 SOM 特征映射空间相似度判别的 软传感器建模变量选择* 侯 杰1,李太福 2,余德君 3,程 杨4 1重庆大学自动化学院,重庆;2重庆科技学院电气与信息学院,重庆; 3重庆电力高等专科学校,重庆;4重庆市农业科学院,重庆 Email: ynhj88311@163.com 收稿日期:2011 年6月20日;修回日期:2011 年7月5日;录用日期:2011 年7月10 日 摘 要:针对软传感器建模中存在的信息冗余,提出一种基于自组织特征映射神经网络(Self-Organizing Feature Mapping,SOM)的变量选择方法。该方法借助 SOM 简单快速的特征映射能力对数据进行投影, 采用虚假最近邻点法(False Nearest Neighbor,FNN)计算某变量删减前后数据在 SOM 投影空间的相似 度,通过相似度来判断其对主导变量的解释能力,由此进行变量的选择。实验结果表明该方法能有效 的进行变量选择,为软传感器建模变量选择提供了一种新思路。 关键词:变量选择;软传感器建模;SOM神经网络;特征空间;虚假最近邻点法 1. 引言 软传感器建模(soft sensor modeling)[1]是利用工业 生产过程中有关的过程变量间的关联,通过某些能够 检测的过程变量和相应的数学模型,估计出过程中未 知变量的技术。在建模时其复杂度随辅助变量增加而 呈指数增长,易出现维度灾难。借助变量选择技术可 剔除冗余特征参数,降低模型复杂性,研究软传感器 建模中的变量选择方法有重要的科学意义和学术价 *国家自然科学基金资助项目(50905194);重庆市自然科学基金资助项 目(CSTC2008BB2356)。  侯杰 等基于 特征映射空间相似度判别的软传感器建模变量选择 17 | SOM 值。 传统变量选择方法主要有前向选择法(Forward Selection)[2],后向剔除法(Backward Elimination)[2],逐 步回归法(Stepwise Regression)[3]等。前向选择法,后 向剔除法这两种方法是单向增加或者减少变量数目, 可以快速的实现变量选择,它们的缺点是:容易陷入 局部极值,且只适合于线性模型。逐步回归法也叫增 l 减 r 法,即搜索方向不再是单向加或者减,可以根据 评估函数灵活的浮动,其问题在于 l和 r 的大小难以确 定且此方法也只适合于线性模型。 针对上述变量选择方法在变量选择中存在的不足 和缺陷,在软传感器建模中普遍采用特征提取消除原 始数据空间的信息冗余,然后在映射后的特征子空间 作特征选择,从而解决判别模型的精度问题、并适当 降低了模型复杂度。主要的特征提取方法有:因子分 析法(Factor Analysis,FA)[4],支持向量机法(Support Vector Machine,SVM)[5],主成分分析法(Principal Component Analysis,PCA)[6],以及它们的一些组合方 法。这些方法在特征提取方面已取得显著的成绩。但 是它们的不足和缺陷在于:FA 计算因子时,采用的是 最小二乘法,此法有时可能会失效;SVM 算法对大规 模训练样本难以实施;PCA 特征提取时间长。 针对这些特征提取方法进行变量选择的不足和缺 陷,一种具有很好的非线性映射投影能力和很好的非 监督学习能力,可以对大样本进行简单,快速处理的 SOM 神经网络被一些研究者所注意,被用来进行变量 选择。文献[7]使用 SOM进行变量选择,该方法由于 只是借助可视化U矩阵分析来进行变量选择,具有很 大的模糊不确定性。文献[8]使用 SOM 神经网络对分 析化学进行变量选择,该方法借助统计学方法进行计 算,运算量大,且对选择变量没有很好的解释能力; 文献[9]使用 SOM 神经网络对光谱分析进行变量选 择,该方法借助统计学方法进行计算且运算量大,对 选择变量没有很好的解释能力;文献[10]使用SOM 神 经网络进行多次重复建模计算进行变量选择,该方法 过程复杂,使用多个不同的神经网络来建模,稳定性 差。 本文提出一种结合自组织特征映射神经网络 (Self-Organizing Feature Mapping,SOM)与虚假最近邻 点法(False Nearest Neighbours,FNN)的变量选择新方 法,简称 SOM-FNN 法。该方法结合利用了 SOM 神 经网络 U矩阵的强大可视化功能及 SOM 能简单,快 速的对数据进行非监督非线性特征映射的优势以及 FNN 法的简单可行的计算能力,从而有效的克服只简 单对 SOM 神经网络可视化分析时的模糊不确定,使 用统计学方法计算量大,不便理解以及重复建模不稳 定等问题。通过简单,方便的计算即可进行变量选择, 从而有效解决上述文献存在的问题。本文使用 Matlab2009a 应用 somtoolbox 软件工具箱来对 SOM-FNN 进行了仿真研究。SOM 神经网络输出层节 点数均采用 样本个数5[11]。 2. 相关理论基础简介 2.1. SOM 神经网络和U矩阵 SOM 神经网络是芬兰赫尔辛基大学神经网络专 家Kohonen 于1981 年提出的竞争式神经网络。它在 训练中能无监督地进行自组织学习,可以把高维信息 数据以有序方式映射到低维网络,形成一种拓扑意义 上的有序图。SOM 神经网络由输出层和输入层 2层构 成。 可视化技术在数据结构分析中有着重要作用。 SOM神经网络的训练结果也必须借助其他方法才能 实现可视化。SOM神经网络常采用 U矩阵,D矩阵 来对其进行可视化。U矩阵是表示神经网络权矢量与 其领域内的神经网络节点之间距离的度量的可视化技 术,由 Ultscu 于1998 年提出[12]。 2.2. 虚假最近邻点法(FNN) 虚假最近邻点法[13]是在高维相空间重构过程中, 随着嵌入维数 增大,从混沌时间序列中恢复混沌运 动的轨迹逐渐打开,相似度高的虚假邻点被逐步剔除, 从而使混沌运动的轨迹得到恢复的一种特征筛选方 法。 m 与计算相距离相比,计算相点的相关性能更全面 地解释虚假最近邻点这一现象。假设一个 维变量组 空间 Q,其中的一个样本点 , 令 n ,q 12 ,, ,, in qq qA 0 i q ,求出样本 在第 维的空间内的投影Ai ,,,0,, n qB 12 qq 。 。 计算, B的相关性: A Copyright © 2011 Hanspub ORF  侯杰 等 | 基于 SOM 特征映射空间相似度判别的软传感器建模变量选择 Copyright © 2011 Hanspub ORF 18 BA BA T cos (1) Step 3:将相应的待分析的变量置零的数据记为 12 ,,,,, in qqq qA ,计算相应的 B。 Step4:计算平均相似度值 BA BA T cos 确定 若 cos 值接近于 1,则说明 A与B的相似度大, 变量 qi对样本影响小,解释能力小;若 cos 较大地 偏离 1,说 明A与B相似性小,变量qi对样本解释能 力较大,此时B即A的虚假最近邻点。 各变量的重要程度,以进行变量选择。 Step 5:把所得到的个n cos 按从小到大的顺序 排列,较大 cos 对应的原始变量没什么贡献,可以 考虑剔除。 3. SOM-FNN 变量选择方法 SOM-FNN变量选择方法如图1所示。 SOM-FNN变量选择方法即通过SO M神经网络将 原始输入数据通过特征映射到新的投影空间,形成 维矩阵(其中m,n为神经网络输出节点数),得 到 数据在SOM特征投影空间的投影向量。接着,使用 FNN思想,将原变量组 nm 12 ,,,,, in qqq qA 中的任 意变量 置为零,得一新的变量组 ,然后将这两个点利用SOM神 经网络进行特征投影将它们转换到SOM特征空间,再 利用虚假最近邻点法(FNN)计算转换后两个点之间的 相似度 i q 12 ,,qq ,0,, n q B cos 。把所得到的 个 n cos 按从小到大的 顺序排列,较大相似度对应的原始变量即没什么贡献, 可以考虑删除。 4. 仿真研究 4.1. 仿真数据 数据 1:使用论文[14]的数据来对 SOM-FNN 进行 仿真研究。模型如下: 45 51 34 YXXε (2) 数据 2:使用论文[15]的数据对 SOM-FNN 进行仿 真研究。模型如下: 2 1234 5 10sin200.5 105 Yxxx xx (3) 数据 3:使用论文[15]的数据对 SOM-FNN 进行仿 真研究。模型如下: 根据以上分析得到 SOM-FNN 变量选择方法的算 法和具体实现步骤如下: SOM-FNN 算法实现步骤如下: 432121XXXXXXT (4) Step 1:首先使用所有变量来对 SOM 神经网络进 行训练。得到和记录相应的神经网络权值 。 W4.2. 仿真结果及分析 Step 2:原来数据记为 ,计 算相应相似度值。 12 ,,,,, in qqq qA A 模型 1:使用全部数据训练SOM 神经网络得到神 经网络可视化 U矩阵图如图 2所示,SOM-FNN 计算 得到的各变量平均相似度值如图3所示。 Table 1. Algorithm of SOM-FNN 表1. SOM-FNN算法 结果分析: 输入: 12 ,,,,, in qqq qA 12 ,,,0,, n qq qB Step1 :实验训练 SOM 神经网络得到权值向 Aw Step2 :虚假最近邻点法 FNN 计算相似度值 For i=1:S For n=1:N U矩阵相关度不是太高。不是某一变量直接可以 表示数据信息。而是某些变量混合作用的结果。 T AAW T BBW cos T AB AB END END Figure 1. Schematic diagram of SOM-FNN 注释:S:变量数;N:输出层神经元个数;输出:变量平均相似度 。 cos 图1. SOM-FNN示意图  侯杰 等基于 特征映射空间相似度判别的软传感器建模变量选择 19 | SOM U-matrix 0.319 0.754 1.19 0.319 X4 d -0.896 0.0462 0.989 -0.896 X2 d -1.0 8 0.00534 1.09 -1.0 8 0.00534 X3 d -1.22 -0.142 0.939 -1.22 -0.142 X4 d -1. 3 3 -0.0515 1.22 -1. 3 3 X5 d -1.4 3 -0.3 14 0.798 -1.4 3 Figure 2. U-matrix map of data 1 图2. 数据 1的U矩阵图 1 2 3 4 5 0.82 0.84 0.86 0.88 0.9 0.92 0.94 1 Figure 3. Average similarity of each variable of data 1 图3. 数据 1各变量平均相似度 使用 SOM-FNN 法对各变量进行相似度计算得到 5个变量的平均相似度值和建模时各变量被选择的顺 序如下表 2所示,符合构造模型预期效果。 模型 2:使用全部数据训练SOM 神经网络得到神 经网络可视化 U矩阵图如图 4所示,SOM-FNN 计 Table 2. Results of data 1 表2. 数据 1计算结果 变量系数 平均相似度 被选顺序 1 0.9386 5 2 0.9137 4 3 0.9034 3 4 0.8330 1 5 0.8338 2 算得到的各变量平均相似度值如图5所示。 结果分析: U矩阵可以看出变量 9,10;变量 4,5一致,通过 SOM神经网络 U矩阵显示。U矩阵和具体某一个变 量没有直接相关关系,而应该是某些变量的混合表示 的结果。 使用 SOM-FNN 法对各变量进行相似度计算得到 10 个变量的平均相似度值和建模时各变量被选择的 顺序如下表 3所示,符合构造模型预期效果。 模型 3:使用全部数据训练SOM 神经网络得到神 经网络可视化 U矩阵图如图 6所示,SOM-FNN 计算 得到的各变量平均相似度值如图7所示。 Table 3. Results of data 2 表3. 数据 2计算结果 变量系数 平均相似度 被选顺序 1 0.9991 3 2 0.9994 4 3 0.9994 5 4 0.9991 2 5 0.9991 1 6 0.9995 6 7 0.9995 7 8 0.9995 8 9 0.9995 9 10 0.9995 10 Copyright © 2011 Hanspub ORF  侯杰 等基于 特征映射空间相似度判别的软传感器建模变量选择 20 | SOM U-ma trix 0. 46 0. 905 X1 d 0. 229 0. 497 0. 766 X2 d 0. 244 0. 518 0. 792 X3 d 0. 258 0. 497 0. 735 X4 d 0. 125 0. 494 0. 864 X5 d 0. 126 0. 495 0. 865 X6 d 0. 286 0. 526 0. 765 X7 d 0.181 0. 482 0. 783 0. 181 X8 d 0. 246 0. 508 0. 77 X9 d 0. 133 0. 51 0. 886 X10 d 0. 163 0. 54 0. 916 Figure 4. U-matrix map of data 2 图4. 数据 2的U矩阵图 1234 5678 910 0. 999 0.9 991 0.9 991 0.9 992 0.9 992 0.9 993 0.9 993 0.9 994 0.9 994 0.9 995 0.9 995 2 Figure 5. Average similarity of each variable of data 2 图5. 数据 2各变量平均相似度 U-matr ix 0. 245 0. 695 1. 14 0. 245 X1 d 0.0 177 0.5 02 0.9 86 0.0177 X2 d 0.0166 0.508 1 0.0166 X3 d 0. 0175 0. 508 0. 999 0. 0175 X4 d 0.0 0321 0.5 0.9 97 0.0 0321 X5 d 0.00276 0.486 0.969 0.00276 X6 d 4.78e-005 0. 479 0. 957 4. 78e-005 0. 479 Figure 6. U-matrix map of data 3 图6. 数据 3的U矩阵图 12 3 4 5 6 0.965 0. 97 0.975 0. 98 0.985 0. 99 0.995 1 3 Figure 7. Average similarity of each variable of data 3 图7. 数据 3各变量平均相似度 结果分析: U矩阵相关度不是太高。不是某一变量直接可以 表示数据信息。而是某些变量混合作用的结果。 使用 SOM-FNN 法对各变量进行相似度计算得到 6个变量的平均相似度值和建模时各变量被选择的顺 序如表 4所示,符合构造模型预期效果。 5. 结语 1) 利用 SOM-FNN 法,通过计算某辅助变量选择 前后的相似度,可以有效地剔除冗余信息,降低模型 复杂度。 2) SOM-FNN法通过计算变量选择前后的相似 度,在建立模型时可以依次得到不同变量的被选顺序, 依次加入变量来建立模型,可以得到理想的模型效果。 Copyright © 2011 Hanspub ORF  侯杰 等基于 特征映射空间相似度判别的软传感器建模变量选择 21 | SOM Table 4. Results of data 3 表4. 数据 3计算结果 变量系数 平均相似度 被选顺序 1 0.9835 3 2 0.9843 4 3 0.9680 1 4 0.9786 2 5 0.9913 5 6 0.9935 6 且计算量小,易于编程实现,可在实际中加以应用。 3) SOM-FNN法可以借助 SOM 神经网络的可视 化U矩阵对结果进行分析,同时,由于结合了 FNN 的计算可以简单,快速的计算得到结果。 参考文献 (References) [1] 王孝红, 刘文光, 于宏亮. 工业过程软测量研究[J]. 济南大学 学报: 自然科学版, 2009, 23(1): 80-86. [2] M. Gevrey, I. Dimopoulos, and S. Lek. Review and comparison of methods to study the contribution of variables in artificial neural network models. Ecological Modelling, 2003, 160(3): 249 -264. [3] Q. R. Chen, C. H. Yang. Quasi-stepwise regression variable selection and its application in rural household net income fore- casting. Systems Engineering: Theory & Practice, 2008, 28(11): 16-22. [4] 贾洪飞, 隽志才, 王晓原等. 利用因子分析选取车辆跟驰模 型输入变量[J]. 公路交通科技, 2004, 21(1): 81-84. [5] K. O. Elish, M. O. Elish. Predicting defect-prone software mod- ules using support vector machines. The Journal of Systems and Software, 2008, 81(5): 649-660. [6] F. Westad, M. Hersleth, P. Lea, et al. Variable selection in PCA in sensory descriptive and consumer data. Food Quality and Pre- ference, 2003, 14(5-6): 463-472. [7] W.-S. Lee, Y.-S. Kwon, J.-C. Yoo, et al. Multivariate analysis and self-organizing mapping applied to analysis of nest-site selec- tionin Black-tailed Gulls. Ecological Modelling, 2006, 193(3-4): 602-614. [8] G. R. Lloyd, K. Wongravee, C. J. L. Silwood, et al. Self organis- ing maps for variable selection: Application to human saliva analyzed by nuclear magnetic resonance spectroscopy to inves- tigate the effect of an oral health care product. Chemometrics and Intelligent Laboratory Systems, 2009, 98(2): 149-161. [9] F. Corona, E. Liitiainen, A. Lendasse, et al. A SOM-based ap- proach to estimating product properties from spectroscopic meas- urements. Neurocomputing, 2009, 73(1-3): 71-79. [10] K. M. Najman, K. Najman. Applying the Kohonen self-organizing map networks to select variables. Data Analysis, Machine Learning and Applications, 2008, 1: 45-54. [11] Y.-S. Pa rk, J. Tison, S. Lek, et al. Application of a self- organiz- ing map to select representative species in multivariate analysis: A case study determining diatom distribution patterns across France. Ecological Informatics, 2006, 1(3): 247-257. [12] 廖广兰, 陈勇辉, 史铁林. 自组织映射网络的可视化研究[J]. 计算机工程与应用, 2003, 39(9): 35-37. [13] 王海燕, 盛昭瀚. 混沌时间序列相空间重构参数的选取方法 [J]. 东南大学学报(自科版), 2000, 30(5): 113-117. [14] R. Philips, I. Guttman. A new criterion for variable selection. Statistics & Probability Letters, 1998, 38(1): 11-19. [15] A. Eleuteri, R. Tagliaferri, and L. Milano. A novel information geometric approach to variable selection in MLP networks. Neural Networks, 2005, 18(10): 1309-1318. Copyright © 2011 Hanspub ORF |