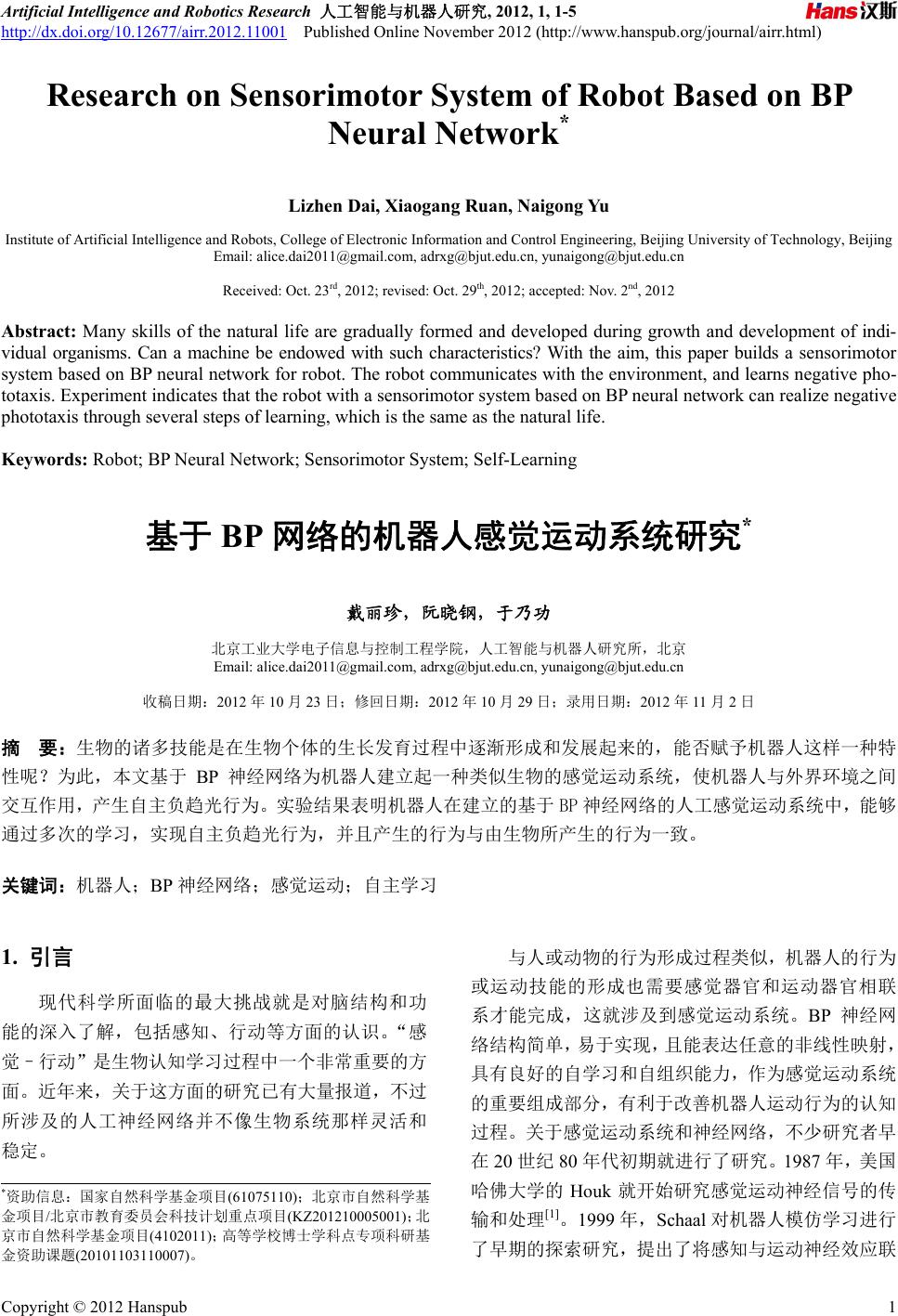

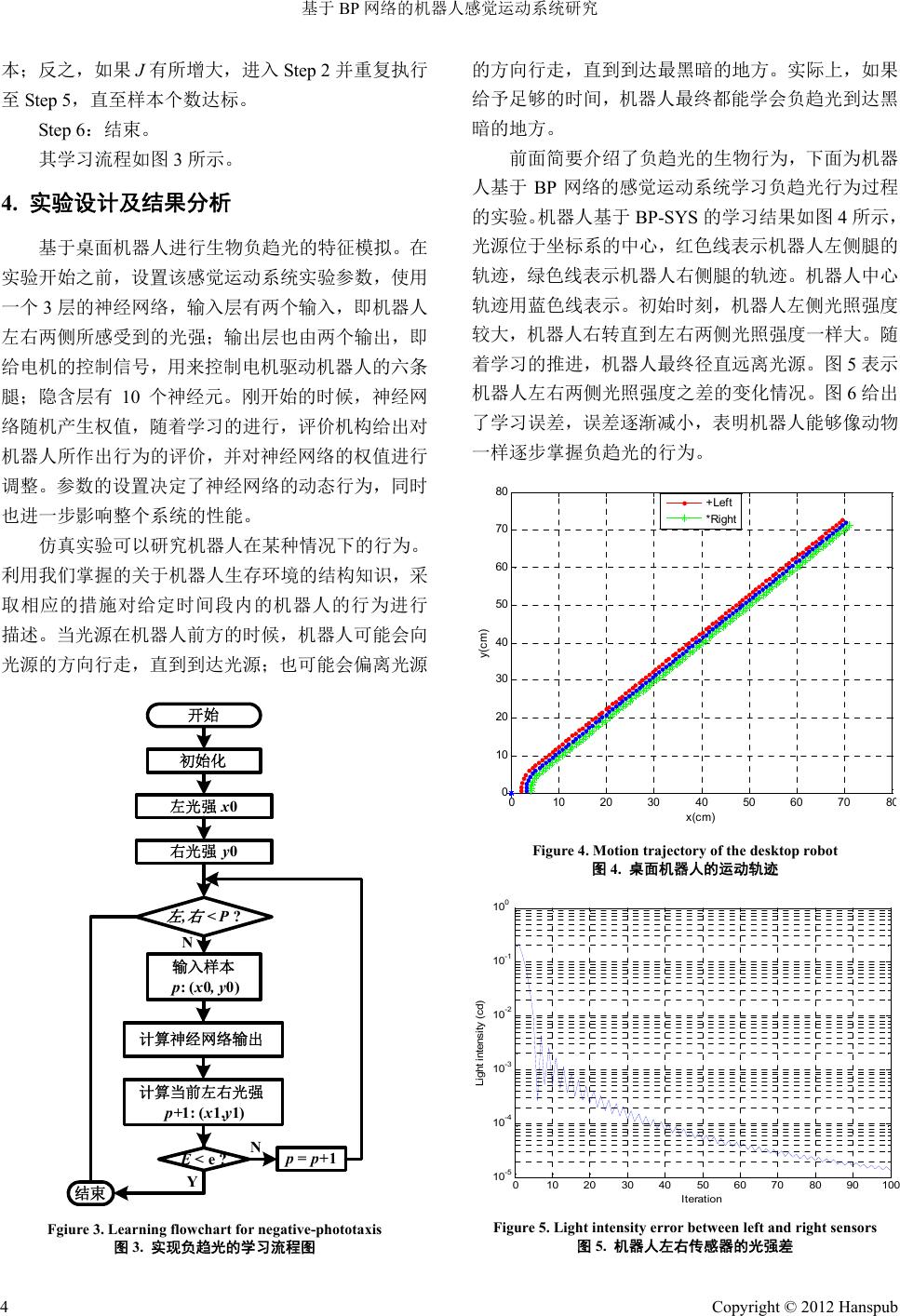

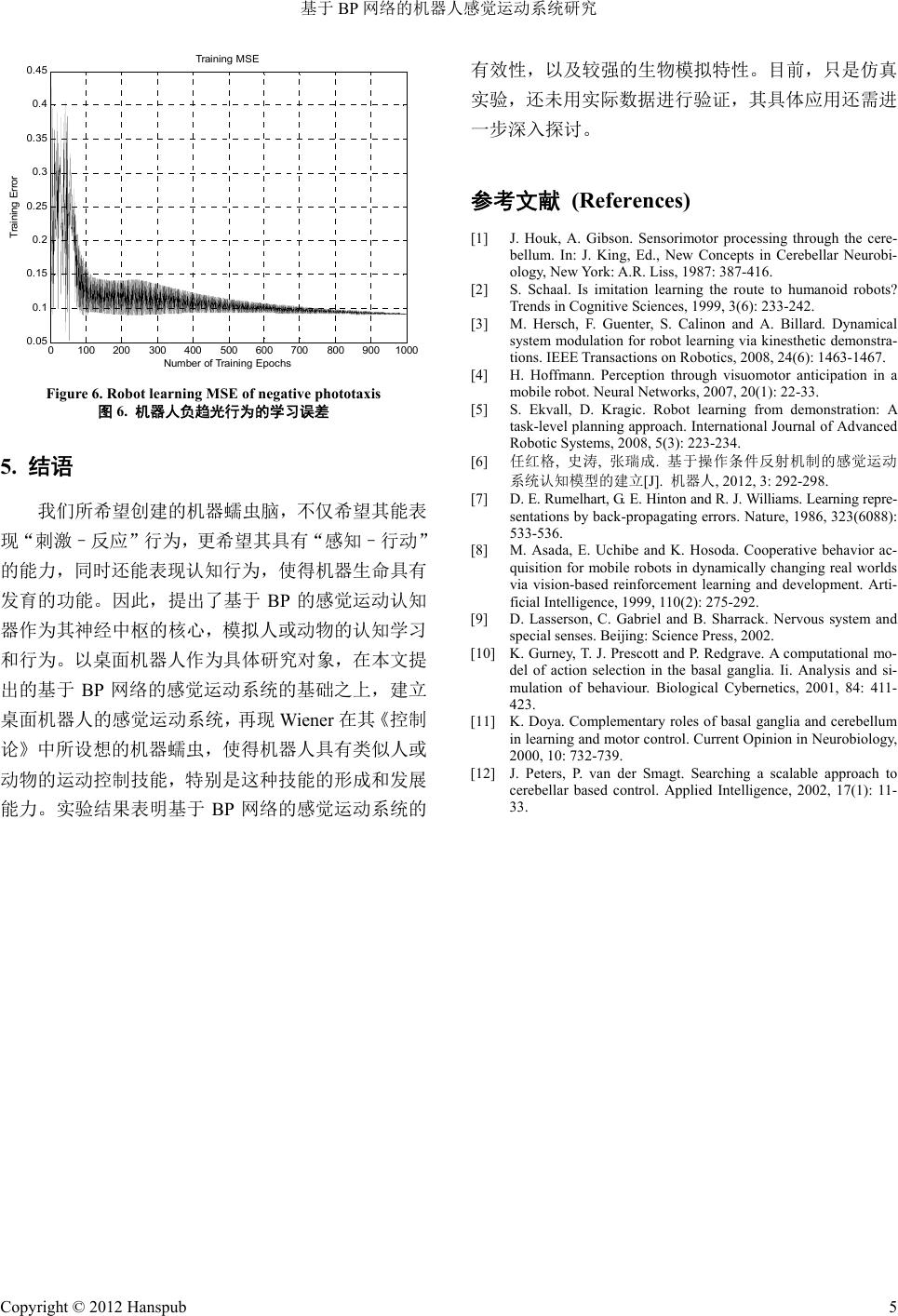

Artificial Intelligence and Robotics Research 人工智能与机器人研究, 2012, 1, 1-5 http://dx.doi.org/10.12677/airr.2012.11001 Published Online November 2012 (http://www.hanspub.org/journal/airr.html) Research on Sensorimotor System of Robot Based on BP Neural Network* Lizhen Dai, Xiaogang Ruan, Naigong Yu Institute of Artificial Intelligence and Robots, College of Electronic Information and Control Engineering, Beijing University of Technology, Beijing Email: alice.dai2011@gmail.com, adrxg@bjut.edu.cn, yunaigong@bjut.edu.cn Received: Oct. 23rd, 2012; revised: Oct. 29th, 2012; accepted: Nov. 2nd, 2012 Abstract: Many skills of the natural life are gradually formed and developed during growth and development of indi- vidual organisms. Can a machine be endowed with such characteristics? With the aim, this paper builds a sensorimotor system based on BP neural network for robot. The robot communicates with the environment, and learns negative pho- totaxis. Experiment indicates that the robot with a sensorimotor system based on BP neural network can realize negative phototaxis through several steps of learning, which is the same as the natural life. Keywords: Robot; BP Neural Network; Sensorimotor System; Self-Learning 基于 BP 网络的机器人感觉运动系统研究* 戴丽珍,阮晓钢,于乃功 北京工业大学电子信息与控制工程学院,人工智能与机器人研究所,北京 Email: alice.dai2011@gmail.com, adrxg@bjut.edu.cn, yunaigong@bjut.edu.cn 收稿日期:2012 年10 月23日;修回日期:2012年10月29日;录用日期:2012 年11月2日 摘 要:生物的诸多技能是在生物个体的生长发育过程中逐渐形成和发展起来的,能否赋予机器人这样一种特 性呢?为此,本文基于BP 神经网络为机器人建立起一种类似生物的感觉运动系统,使机器人与外界环境之间 交互作用,产生自主负趋光行为。实验结果表明机器人在建立的基于 BP 神经网络的人工感觉运动系统中,能够 通过多次的学习,实现自主负趋光行为,并且产生的行为与由生物所产生的行为一致。 关键词:机器人;BP 神经网络;感觉运动;自主学习 1. 引言 现代科学所面临的最大挑战就是对脑结构和功 能的深入了解,包括感知、行动等方面的认识。“感 觉–行动”是生物认知学习过程中一个非常重要的方 面。近年来,关于这方面的研究已有大量报道,不过 所涉及的人工神经网络并不像生物系统那样灵活和 稳定。 与人或动物的行为形成过程类似,机器人的行为 或运动技能的形成也需要感觉器官和运动器官相联 系才能完成,这就涉及到感觉运动系统。BP 神经网 络结构简单,易于实现,且能表达任意的非线性映射, 具有良好的自学习和自组织能力,作为感觉运动系统 的重要组成部分,有利于改善机器人运动行为的认知 过程。关于感觉运动系统和神经网络,不少研究者早 在20 世纪 80 年代初期就进行了研究。1987 年,美国 哈佛大学的 Houk 就开始研究感觉运动神经信号的传 输和处理[1]。1999 年,Schaal 对机器人模仿学习进行 了早期的探索研究,提出了将感知与运动神经效应联 *资助信息:国家自然科学基金项目(61075110);北京市自然科学基 金项目/北京市教育委员会科技计划重点项目(KZ201210005001);北 京市自然科学基金项目(4102011);高等学校博士学科点专项科研基 金资助课题(20101103110007)。 Copyright © 2012 Hanspub 1  基于 BP 网络的机器人感觉运动系统研究 系起来方法[2]。2006 年,Hersch 等人的系统容许机器 人通过肌肉运动知觉示范(Kinesthetic Demonstration) 学习简单的有意图的手势,完成了机器人将物体放入 盒子和将物体从盒子中取出的技能学习实验[3]。2007 年,德国关于人类认知和脑科学的认知机器人研究所 的Hoffmann[4]研究了一种视觉运动神经系统,并将其 应用于移动机器人上,使得移动机器人能够学习预测 视觉输入信号的变化,进而判别前方障碍物的距离, 最终习得找到合适出口的技能。2008年,Ekvall 和 Kraqic 提出了一种任务级的规划方法,完成了机器人 取放(Pick-and-Place)实验[5]。2012 年,任红格等[6]提 出一种基于 Skinner 操作条件反射的感觉运动模型, 并将其用于机器人的自平衡控制,取得了良好的控制 效果。 感觉运动系统和神经网络都与人或动物的运动 行为技能的形成和改善有着紧密的联系,但是,使机 器人复制或模拟这种运动行为技能的研究却在两条 平行线上进行。而且,将感觉运动系统应用于机器人 的运行行为方面的研究还较少,而把二者结合起来作 为机器人仿生自主学习算法用于机器人认知行为的 研究甚少。本文提出一种基于 BP神经网络模型的感 觉运动算法,并应用于桌面机器人行为认知学习,使 之通过学习和训练,再现机器人类似于人或动物的认 知行为技能以及这种技能的形成和发展能力,仿真实 验验证了该算法的有效性。 2. 人工神经网络 感觉运动系统是一个由感觉到运动的系统,其基 本功能就是“感知–行动”。它也是一个综合了感受 器功能和运动神经技能的神经生理组织,其基本的神 经活动可以由神经网络来完成。研究人员根据不同的 机理提出了多种人工神经网络模型,其中最为典型的 模型有 McCulloch-Pitts 模型、感知器、BP 网络、径 向基函数网络、Hopfield 网络、Boltzmann 机、自组 织特征图以及适应谐振理论等。1986 年Rumelhart 和 McCelland[7] 针对前馈网络提出了基于误差反向传播 的学习算法,即 BP 算法,解决了困扰感知器性能的 问题,使人工神经网络的计算能力大大提高。采用 BP 算法的前馈网络被称为BP 网络,BP网络是应用范围 最为广泛的神经网络模型之一。 BP 网络的通用逼近性以及良好的泛化能力,能 从样本数据中学习知识,抽象一般性规律;具有记忆 能力,当隐含神经元可以任意配置时,BP 网络能记 忆任意给定的学习样本,再现样本输入到样本输出的 联想关系;具有学习功能,通过学习,BP 网络能在 任意精度范围内表达复杂的非线性映射;另外,其结 构简单易于实现。基于 BP 神经网络的上述优点,本 文拟采用 BP 神经网络作为构建感觉运用系统的工 具,来模拟人或动物大脑的感觉运动系统,特别是认 知行为的感觉运动系统。 3. 感觉运动系统设计 感觉运动系统的这种从刺激到运动的过程是一 种由“反射–感觉运动神经映射–感知–自主运动– 高级认知”的过程[8],也是由低级向高级不断发展和 完善的渐进认知发育过程,通过学习和发育产生更高 级的认知功能,这对于更加智能的人工系统来说是一 个质的飞跃。 感觉运动系统是一个综合了感受器功能和运动 神经技能的神经生理组织,是一个具有感觉运动控制 的系统[9],如图 1所示。它不仅包括大脑皮层、小脑、 基底核,还包括感觉器官和运动器官。其中,小脑作 为系统的逆控制器,利用来自下橄榄的攀援纤维的误 差信号,对不同的状态选择不同的控制动作;基底核 作为感觉运动系统中的一个功能子系统,它的计算作 用通常被认为是与行为选择的高水平部分相关[10],而 黑质网状部的多巴胺信号起着重要的指导作用;丘脑 是信号传递的中继站,负责集中所有感官接收的来自 外界的信息(除了嗅觉)并传给大脑皮层;大脑皮层的 最根本作用是可以从高维感觉输入中提取重要的信 息,结合来自不同感觉形态中的输入,能够根据前后 联系补充遗漏掉了的部分,完成一个非常复杂的功 能,而本文把它简化为小脑和基底核协同工作的缓冲 运动 命令 感觉 输入 小脑 基底 核 大脑皮层 丘脑 感觉 预测 Figure 1. Structure of the biological sensor-motor system 图1. 生物感觉运动系统结构简图 Copyright © 2012 Hanspub 2  基于 BP 网络的机器人感觉运动系统研究 器,只对信号进行提取和过滤,以便进行分析、思考、 策划及决定,从而形成了小脑和基底核之间的回路联 系[11]。 人或动物的姿态运动是与感觉运动系统相关的, 他们即使处在一个及其复杂的环境中,也能够进行精 确的运动控制,这是由于人或动物是通过感觉运动系 统的学习与训练来控制运动的,它们的学习过程也是 一个由不会到会的循序渐进、逐渐成熟的过程[12]。为 了模拟人类的这种认知能力,并分析人类各部分之间 的相互作用,构建了基于BP 的感觉运动系统模型 (BP-Based Sensorimotor System, BP-SMS)。 3.1. 基于BP的感觉运动系统的结构设计 我们希望创造设计的智能体,不仅希望其能表现 “刺激–反应”行为,更希望其具有“感知–行动” 的能力,同时还能表现认知行为,使得机器生命具有 发育的功能。因此将提出的所谓的基于 BP的感觉运 动认知器作为其神经中枢的核心。基于 BP的感觉运 动系统框图如图 2所示。其中,传感器 sensors 对应 于生物感觉运动系统的感觉输入,电机 motors 相当于 运动命令输出,其余部分对应于大脑皮层、丘脑、基 底核以及小脑部分,并且相应部分实现对应器官的功 能。 桌面机器人如同生物一样,是一种“刺激–反应” 和一种“感知–行动”相结合的机构。生物的“刺激 –反应”和“感知–行动”机制常常是在其与生存环 境交互作用的过程中自治地和自组织地建立起来的。 基于 BP 的感觉运动系统可作为一种人工脑,使具有 认知发育机制的桌面机器人像生物一样,在与环境交 互作用的过程中进行归纳和类比学习,自治地和自组 织地建立起“刺激”和“反应”之间的联系,从而自 发地形成符合其生存目的的“感知–行动”机制。 Assessor Sensors Motors Neural Ne twor k … … … Figure 2. Sensorimotor system based on BP 图2. 基于 BP 的感觉运动系统 桌面机器人的最重要的感觉运动系统就是趋光/ 负趋光等取向性系统,其感觉系统由桌面机器人左右 两侧的四个光传感器和前端的红外传感器组成,其运 动系统由左右两侧的伺服电机组成。 3.2. 感觉运动算法及步骤 设机器人左侧光照强度的期望值为 expL x ,机器人 右侧光照强度的期望值 expR x ,控制目标为机器人朝向 光照强度变弱的方向走,定义其目标函数为: 0 22 0 22 1 exp2exp , 1 1 RL T RL T LL RR t Jutut et et T x xxx T dt (1) 这里的目标函数就是性能泛函,其中, L x 机器人在 t 时刻的左侧光照强度, R x 为机器人在t时刻的右侧光 照强度, 1 和2 为权重系数。在性能指标(1)的意义 下,机器人负趋光问题转换成生成最优指令使得目标 函数尽可能小。 机器人的学习模式设置如下: 1) 训练开始时:Robot 随机生成初始位置和航向, 保持左转右转的速度vL = vR = 1。 2) 训练过程中:每当 Robot 向光照强度大的方向 运行一个时刻后,BP-SMS根据 Robot的学习信息判 断动作方向,并自治地反复学习,直至达到终止条件 (如光强IL, IR < ε或t > T)。 3) 学习结束后:当达到终止条件后,机器人停止 运动,并随机初始化位置及航向,然后开始新一轮的 负趋光学习。 基于 BP 神经网络的感觉运动系统控制机器人实 现负趋光的算法步骤如下: Step 1:采集样本:初始化位置、得到相应的网 络输入:光照强度。 Step 2:神经网络进行计算,并输出下一时刻机 器人的位置。 Step 3:电机转动,机器人移动至新的位置。 Step 4:根据新位置的坐标,检测光照强度,并 根据公式(1)计算目标函数J。 Step 5:判 断J的变化情况。如果J较前一时刻有 所减小,则将机器人的位置坐标保存起来留作学习样 Copyright © 2012 Hanspub 3  基于 BP 网络的机器人感觉运动系统研究 本;反之,如果J有所增大,进入Step 2 并重复执行 至Step 5,直至样本个数达标。 Step 6:结束。 其学习流程如图 3所示。 4. 实验设计及结果分析 基于桌面机器人进行生物负趋光的特征模拟。在 实验开始之前,设置该感觉运动系统实验参数,使用 一个 3层的神经网络,输入层有两个输入,即机器人 左右两侧所感受到的光强;输出层也由两个输出,即 给电机的控制信号,用来控制电机驱动机器人的六条 腿;隐含层有 10 个神经元。刚开始的时候,神经网 络随机产生权值,随着学习的进行,评价机构给出对 机器人所作出行为的评价,并对神经网络的权值进行 调整。参数的设置决定了神经网络的动态行为,同时 也进一步影响整个系统的性能。 仿真实验可以研究机器人在某种情况下的行为。 利用我们掌握的关于机器人生存环境的结构知识,采 取相应的措施对给定时间段内的机器人的行为进行 描述。当光源在机器人前方的时候,机器人可能会向 光源的方向行走,直到到达光源;也可能会偏离光源 开始 初始化 左光强 x0 右光强 y0 输入样本 p: (x0, y 0) 计算神经网 络 输出 左 , 右 < P ? 结束 p = p+1 Y N 计算当前左 右 光强 p+1: ( x1,y1) N E<e ? Fgiure 3. Learning flowchart for negative-phototaxis 图3. 实现负趋光的学习流程图 的方向行走,直到到达最黑暗的地方。实际上,如果 给予足够的时间,机器人最终都能学会负趋光到达黑 暗的地方。 前面简要介绍了负趋光的生物行为,下面为机器 人基于 BP 网络的感觉运动系统学习负趋光行为过程 的实验。机器人基于BP-SYS 的学习结果如图 4所示, 光源位于坐标系的中心,红色线表示机器人左侧腿的 轨迹,绿色线表示机器人右侧腿的轨迹。机器人中心 轨迹用蓝色线表示。初始时刻,机器人左侧光照强度 较大,机器人右转直到左右两侧光照强度一样大。随 着学习的推进,机器人最终径直远离光源。图5表示 机器人左右两侧光照强度之差的变化情况。图 6给出 了学习误差,误差逐渐减小,表明机器人能够像动物 一样逐步掌握负趋光的行为。 010 20 3040 50 60 708 0 0 10 20 30 40 50 60 70 80 x(cm) y(cm) +Left *Right Figure 4. Motion trajectory of the desktop robot 图4. 桌面机器人的运动轨迹 010 2030 4050 60 7080 9010 0 10 -5 10 -4 10 -3 10 -2 10 -1 10 0 Iteration Light intensity (cd) Figure 5. Light intensity error between left and right sensors 图5. 机器人左右传感器的光强差 Copyright © 2012 Hanspub 4  基于 BP 网络的机器人感觉运动系统研究 Copyright © 2012 Hanspub 5 0100 200300 400 500 600 700 800900 1000 0.05 0. 1 0.15 0. 2 0.25 0. 3 0.35 0. 4 0.45 Number of Training Epoc hs Training Error Traini ng M SE Figure 6. Robot learning MSE of negative phototaxis 图6. 机器人负趋光行为的学习误差 5. 结语 我们所希望创建的机器蠕虫脑,不仅希望其能表 现“刺激–反应”行为,更希望其具有“感知–行动” 的能力,同时还能表现认知行为,使得机器生命具有 发育的功能。因此,提出了基于 BP的感觉运动认知 器作为其神经中枢的核心,模拟人或动物的认知学习 和行为。以桌面机器人作为具体研究对象,在本文提 出的基于 BP 网络的感觉运动系统的基础之上,建立 桌面机器人的感觉运动系统,再现Wiener 在其《控制 论》中所设想的机器蠕虫,使得机器人具有类似人或 动物的运动控制技能,特别是这种技能的形成和发展 能力。实验结果表明基于 BP 网络的感觉运动系统的 有效性,以及较强的生物模拟特性。目前,只是仿真 实验,还未用实际数据进行验证,其具体应用还需进 一步深入探讨。 参考文献 (References) [1] J. Houk, A. Gibson. Sensorimotor processing through the cere- bellum. In: J. King, Ed., New Concepts in Cerebellar Neurobi- ology, New York: A.R. Liss, 1987: 387-416. [2] S. Schaal. Is imitation learning the route to humanoid robots? Trends in Cognitive Sciences, 1999, 3(6): 233-242. [3] M. Hersch, F. Guenter, S. Calinon and A. Billard. Dynamical system modulation for robot learning via kinesthetic demonstra- tions. IEEE Transactions on Robotics, 2008, 24(6): 1463-1467. [4] H. Hoffmann. Perception through visuomotor anticipation in a mobile robot. Neural Networks, 2007, 20(1): 22-33. [5] S. Ekvall, D. Kragic. Robot learning from demonstration: A task-level planning approach. International Journal of Advanced Robotic Systems, 2008, 5(3): 223-234. [6] 任红格, 史涛, 张瑞成. 基于操作条件反射机制的感觉运动 系统认知模型的建立[J]. 机器人, 2012, 3: 292-298. [7] D. E. Rumelhart, G. E. Hinton and R. J. Williams. Learning repre- sentations by back-propagating errors. Nature, 1986, 323(6088): 533-536. [8] M. Asada, E. Uchibe and K. Hosoda. Cooperative behavior ac- quisition for mobile robots in dynamically changing real worlds via vision-based reinforcement learning and development. Arti- ficial Intelligence, 1999, 110(2): 275-292. [9] D. Lasserson, C. Gabriel and B. Sharrack. Nervous system and special senses. Beijing: Science Press, 2002. [10] K. Gurney, T. J. Prescott and P. Redgrave. A computational mo- del of action selection in the basal ganglia. Ii. Analysis and si- mulation of behaviour. Biological Cybernetics, 2001, 84: 411- 423. [11] K. Doya. Complementary roles of basal ganglia and cerebellum in learning and motor control. Current Opinion in Neurobiology, 2000, 10: 732-739. [12] J. Peters, P. van der Smagt. Searching a scalable approach to cerebellar based control. Applied Intelligence, 2002, 17(1): 11- 33. |